انحياز تأكيدي

الانحياز التأكيدي (أو الانحياز الذاتي) هو الميل للبحث عن، وتفسير، وتذكُّر المعلومات بطريقة تتوافق مع معتقدات وافتراضات الفرد، بينما لا يولي انتباهًا مماثلًا للمعلومات المناقضة لها.[ملحوظة 1][1] هو نوع من الانحياز المعرفي والخطأ في الاستقراء. يُظهر الأشخاص هذا الانحياز عندما يجمعون أو يتذكّرون المعلومات بشكل انتقائي، أو عندما يفسّرونها بطريقة متحيّزة. يكون تأثير ذلك أقوى في المسائل المحكومة عاطفيًا والمعتقدات الراسخة بشدّة. يميل الأشخاص أيضًا إلى تفسير الأدلة الغامضة بشكل يدعم موقفهم الراهِن. استُشهد بالانحياز في البحث، والتفسير، والذاكرة لتأويل تضارُب الموقف (عندما يُصبح الخلاف أكثر حِدَّة برغم توافُر الأدلة نفسها لدى الأطراف المتنازعة)، ورسوخ الاعتقاد (عندما يستمر الاعتقاد بعد توضيح أن الدليل الذي يدعمه خاطئ)، تأثير الأسبقيّة غير المنطقيّة (الاعتماد بشكل أكبر على أوّل ما وُجد من سلسلة معلومات) والربط الوهمي (عندما يوجد اعتقاد خاطئ بارتباط حدثين أو موقفين).

| جزء من سلسلة مقالات حول |

| المغالطات المنطقية |

|---|

|

|

مغالطات غير صوريَّة

|

|

مغالطات الارتباط

|

| بوابة منطق |

أظهرت سلسلة من التجارب في ستّينات القرن العشرين أنّ الأشخاص ينحازون نحو تأكيد معتقداتهم الحاليّة. أعيد تفسير تلك النتائج بتجارب لاحقة بيّنت وجود ميل نحو اختبار الأفكار من جانب واحد، مع التركيز على احتمال واحد وتجاهل البدائل. في مواقف معيّنة، يُمكن لهذه النزعة أن تؤثّر على استنتاجات الأشخاص. تتضمَّن تفسيرات أسباب الانحيازات الملحوظة: التفكير الرغبوي وقدرة الإنسان المحدودة على معالجة المعلومات. يوجد تفسير آخر وهو ظهور الانحياز التأكيدي لدى الأشخاص لأنهم يقومون بِحساب العواقب في حال كونهم على خطأ، بدلًا من البحث بطريقة حياديّة وعلميّة.

يدعَم الانحياز التأكيدي الثقة المبالغة بالمُعتقدات الشخصية ويحفظ ويقوِّي المُعتقدات في وجه الأدلّة المعاكِسة. هناك أمثلة عدّة على القرارات السيّئة الناتجة عن الانحياز التأكيدي في السياق السياسي والتنظيمي.[2][3][ملحوظة 2]

أنواعه

يمكن اعتبار الانحيازات التأكيدية على أنّها تأثيرات في استيعاب المعلومات. فهي تختلف عما يُدعى أحيانًا تأثير التأكيد السلوكي، المعروف عمومًا بنبوءة ذاتية التحقق، حيث تؤثِّر توقّعات الفرد على تصرّفاته، ويساعد السلوك في تحقيق النتائج التي توقّعها الفرد.[4]

يحصُر بعض علماء النفس مصطلح "الانحياز التأكيدي" في الجمع الانتقائي للأدلّة، التي تدعم ما يؤمن به المرء، وتجاهُل أو رفض الأدلّة التي تؤيّد ناتجًا آخر. يُطبِّق علماء نفس آخرين المصطلح بشكل أوسع فيشمل نزعة الحفاظ على مُعتقدات الفرد عند البحث عن أدلّة، أو تفسيرها، أو استذكارها.[5][ملحوظة 3]

بحث انحيازي عن المعلومات

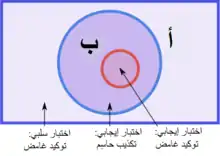

اكتشف الخبراء تكرارًا أن الأشخاص يميلون إلى اختبار الفرضيات من منظور واحد، بالبحث عن أدلّة تتناسب مع افتراضاتهم الحالية.[7][8] بدلًا من البحث في كافّة الأدلّة المرتبطة بالموضوع، يقومون بصياغة أسئلة للحصول على إجابة تؤكد وتدعم افتراضاتهم.[9] يقوم هؤلاء الأشخاص بالتركيز على النتائج المتوقَّعة في حال ثُبوت صحّة افتراضاتهم، وليس ما قد يحدث إذا اتَّضح أنّها خاطئة.[9] على سبيل المثال، عند استخدام أسئلة نعم/لا للعثور على رقم يُرجَّح هو (أو هي) أنّه رقم ثلاثة فقد يسأل الشخص "هل هو رقم فردي؟" يُفضِّل الناس هذا النوع من الأسئلة، ويُدعى "اختبار إيجابي"، حتى وإن كان الاختبار العكسي (السلبي) مثل "هل هو رقم زوجي؟" سيعطي المعلومة ذاتها.[10] لكن هذا لا يعني أنّ الناس يتقيَّدون باختبارات تضمن نتيجة بالإيجاب. في الدراسات حيث يختار الخاضعون للاختبار إمَّا اختبارات مزيفة أو أخرى تشخيصيّة صادقة، فهم يُفضِّلون التشخيصيّة.[11][12]

لا يُعتبَر تفضيل الاختبارات الإيجابيّة انحيازًا بحدّ ذاته، حيث يمكنها أن تُعطي معلومات وفيرة.[13] لكن، بدمجها مع عوامل أخرى، يُمكن لهذه الطريقة تأكيد الاعتقادات أو الافتراضات الحاليّة، بغضّ النظر عن صحّتها.[14] في المواقف الواقعية، يكون الدليل مُعقَّدًا ومُحيِّرًا. على سبيل المثال، في حال وجود أفكار عديدة متناقضة حول شخص ما، يُمكن دعم كل منها بالتركيز علي جانب واحد من سلوكياته.[8] إذًا فإنّ أيّ بحث عن أدلّة لصالح افتراض ما، غالبًا ما ينجح.[14] يتَّضِح ذلك في أنَّ صياغة السؤال يُمكنها تغيير الإجابة بشكل ملحوظ.[8] على سبيل المثال، مَن يُسألون "هل أنت سعيد بحياتك الاجتماعيّة؟" يظهر لديهم رِضى أكبر من هؤلاء الذين يُسالون "هل أنت غير سعيد بحياتك الاجتماعية؟".[15]

يُمكن لأيّ تغيير طفيف في كلمات السؤال التأثير على كيفية بحث الأشخاص في المعلومات المتاحة، وبالتالي على النتائج التي يَصلون إليها. اتَّضح هذا باستخدام قضية خيالية تدور حول الوصاية على طفل.[16] قرأ المشاركون أن الوالِد (أ) مناسب بعض الشيء ليكون الوصيّ من نواحٍ عدّة. في حين تميَّز الوالد (ب) بمزيج من الصفات البارزة الإيجابيّة والسلبيّة: العلاقة وطيدة مع الطفل، لكن الوظيفة سوف تُبقيه بعيدًا عنه لفترات طويلة. عندما طُرح السؤال، "أيّ من الوالدين يجب أن يحصل على وصاية الطفل؟" اختار أغلبيّة المشاركون الوالد (ب)، نظرًا للصفات الإيجابيّة بشكل أساسي. بالرغم من ذلك، عندما سُئلوا "أيّ من الوالدين يجب أن يُمنَع من الوصاية على الطفل؟" فقد بحثوا عن صفات سلبيّة، وأجاب الأغلبيّة أنّ الوالد (ب) يجب أن يُمنَع من الوصاية، ممّا يدلّ ضمنًا أنّ الوالد (أ) يجب أن يحصل على الوصاية.[16]

عَرضَت دراسات مشابهة كيفيّة قيام الأشخاص ببحث انحيازي عن المعلومات، لكنّها أوضحت أيضًا أنّ هذه الظاهرة يُمكن تقنينها عبر تفضيل الاختبارات التشخيصيّة الصادقة. في تجربة أوليَّة، قام المشاركون بتصنيف شخص آخر حسب أحد أبعاد الشخصية وهو الانفتاح والانطواء في مُقابلة عَمَل، بحيث يتمّ اختيار أسئلة المُقابلة من قائمة مُعيَّنة. عندما قُدِّم من يخضع للمقابلة بصفته انطوائي، اختار المشاركون أسئلة تفترض الانطواء، مثلًا، "ما الذي تجده مزعجًا في الحفلات الصاخبة؟" وعندما قُدِّم إليهم بصفته منفتح، معظم الأسئلة تقريبًا افترضت الانفتاح، مثلًا، "ماذا تفعل لجلب الحيوية إلى حفلٍِ مُملّ؟" هذه الأسئلة المُحمَّلة بالتكهُّنات تُعطي الخاضِعين للمقابلة فُرصةً ضئيلةً أو منعدمةً لتكذيب الافتراضات التي نشأت حولهم.[17] أُعطِي المشاركون في نسخة لاحقة من التجربة أسئلة قليلة الافتراضية ليختاروا منها، على سبيل المثال، "هل تخجل وتهرب من مواقف التفاعُل الاجتماعي؟"[18] وقد حبُّذوا استخدام تلك الأسئلة الأكثر تشخيصيّة، ممّا يوحي بقِلَّة الانحياز نحو اختبارات التأكيد الإيجابيّة. وقد تكرَّر هذا النمط من تفضيل الاختبارات التشخيصيّة على الاختبارات التأكيديّة في دراسات أخرى.[18]

تؤثِّر سمات الشخصيّة على عمليّات البحث الانحيازيّة وتتفاعل معها.[19] تتفاوَت قدرات الأفراد في حماية سلوكيّاتهم تجاه الهجمات الخارجيّة المتعلّقة بالتعرُّض الانتقائي. يحدُث التعرُّض الانتقائي عندما يبحث الأفراد عن معلومات منسجمة، ليست متناقضة، مع معتقداتهم الشخصية.[20] هناك تجربة بحثت مدى رفض الأفراد للنقاشات التي تتعارض مع معتقداتهم الشخصيّة.[19] ذوي مستويات الثقة العالية لديهم قابليَّة أكبر للسعي نحو معلومات تتعارض مع موقفهم الشخصي لبناء نقاش. أما ذوي الثقة المنخفضة فلا يسعَون نحو معلومات مُعاكِسة، بل يُفضِّلون تلك التي تؤيّد موقِفهم الشخصي. يستخرِج الأشخاص الأدلَّة المنحازة لمعتقداتهم وآرائهم ويقيِّمونها في النقاشات.[21] تُقلِّل مستويات الثقة المرتفعة من تَفضيل المعلومات المؤيِّدة لمعتقدات الفرد.

هناك تجربة أخرى أسنَدت للمشاركين فيها مهمّة مُعقَّدة لاكتشاف القاعِدة تتضمَّن أجسام متحرّكة يُظهِرها الحاسب الآلي.[22] اتَّبَعت الأجسام الظاهرة على شاشة الحاسب الآلي قوانين محدّدة، يجِب على المشاركين اكتشافها. لذا، قَذف المشاركون أشياءً نحو الشاشة لاختبار افتراضاتهم. بالرغم مِن المحاولات العديدة على مدى جلسة استمرّت عشر ساعات، لم يستطِع أيٌ مِن المُشاركين معرفة قواعد النِظام. لقد حاولوا توكيد افتراضاتهم لا تكذيبها، وتردّدوا في التفكير بالبدائل. حتى بعد رؤية أدلّة موضوعيّة تنفي افتراضاتهم، استمرّوا في خوض الاختبارات ذاتها. أعطي لبعض المُشاركين دروس لمعرفة الطُّرُق المناسبة لاختبار الفرضيّات، إلا أنّه لم يكن لتلك التعليمات أيّ تأثير تقريبًا.[22]

تفسير انحيازي

لا تنحصر الانحيازات التأكيديّة في مجموعة من الأدلَّة. حتّى إن كان لدى شخصين المعلومات ذاتها، فطريقة تفسيرهما قد تكون متحيِّزة.

قام فريق في جامعة ستانفورد بإجراء تجربة تتضمَّن مشاركين لديهم آراء قويّة حول عقوبة الإعدام، نِصفهم مؤيِّد والنصف الآخر معارض.[24][25] قرأ كل مشارك مواصفات دراستين: مقارنة بين الولايات الأمريكية بعقوبة الإعدام وبدونها، ومقارنة بين معدَّلات القتل قبل وبعد تطبيق عقوبة الإعدام في ولاية ما. بعد قراءة وصف سريع للدراستين، سُئِل المشاركين إن كانت آرائهم قد تغيّرت. بعد ذلك، قرأوا وصفًا أكثر تفصيلًا لمسار تلك الدراسات وكان عليهم تقييم إذا كان البحث جيّدًا ومقنعًا أم لا.[24] في الواقع، كانت الدراسات تخيّليّة. قيل لنصف المشاركين إنَّ إحدى الدراستين تدعم النظام الرادع والأخرى تعوقه، أما بالنسبة للمشاركين الآخرين حدَث إبدال في الاستنتاجات.[24][25]

لوحظ حدوث تحوُّل طفيف في ميل المشاركين، مؤيّدين أو معارضين، إلى أوّل دراسة قرأوها. بعد قراءة الوصف الأكثر تفصيلًا للدراستين، عاد جميعهم تقريبًا إلى اعتقادهم الأصلي بغض النظر عن الأدلّة المقدّمة، مشيرين إلى التفاصيل التي تدعم وجهة نظرهم ومتجاهلين لأي شيء يتعارض معها. وصَف المُشاركون الدراسات الداعمة لآرائهم السابقة بأنها متفوَّقة على تلك المناقضة، وذلك بطرق مفصَّلة ومحدَّدة.[24][26] حين كتابته عن دراسة يبدو أنها تُقلِّل من شأن تأثير الرَدع، كتب شخص مؤيد لعقوبة الإعدام، "لم يجر البحث خلال فترة زمنية طويلة بشكل كافِ"، بينما علَّق شخصٌ معارضٌ على الدراسة نفسها وقال، "لم يُقَدَّم دليل قوي يُعارِض الباحثين".[24] أوضحت نتائج التجربة أنَّ الأشخاص يضعون معايير أعلى لأدلّة الافتراضات التي تتعارض مع توقّعاتهم الحاليّة. هذا التأثير المعروف باسم "انحياز تكذيبي"، دعمته تجارب أخرى.[27]

أجريت دراسة أخرى حول التفسير الانحيازي أثناء الانتخابات الرئاسية في الولايات المتحدة عام 2004 وتضمَّنت مُشاركين لديهم مشاعر قويّة تجاه المرشَّحِين.

عُرضَت عليهم أزواج مِن التصريحات المتناقِضة، سواء للمرشَّح الجمهوري جورج دبليو بوش، أو المرشَّح الديمقراطي جون كيري أو شخصيّة عامّة محايدة سياسيًا. عُرضَت عليهم أيضًا تصريحات إضافيّة جعلت التناقُض الواضح يبدو منطقيًا. مِن تلك المعلومات الثلاث، وجب عليهم أن يقرّروا إذا ما كانت تصريحات كلّ فرد مُتناغِمة أم لا.[28] كانت هناك اختلافات شديدة في تلك التقييمات، حيث يُرجَّح أن يفسِّر المشاركون تصريحات مُرشَّح يعارضونه على أنها مُتناقضة.[28]

في تلك التجربة، أصدَر المُشاركون أحكامهم أثناء وجودهم بجهاز تصوير بالرنين المغناطيسي (إم آر آي) الذي راقَب نشاطهم الدماغي. عندما قيَّم هؤلاء المشاركون تصريحات متناقِضة لمرشّحهم المفضّل، أثار ذلك مراكز العاطفة في دماغهم؛ ولم يحدث ذلك مع تصريحات الشخصيّات الأخرى. استنتجت التجارب أنّ ردود الأفعال المختلفة تجاه التصريحات لم تنتج عن أخطاء التفكير السلبي؛ بل كان المشاركون يقلِّلون من التنافر المعرفي الناجم عن قراءة التصرّفات اللاعقلانية لمرشَّحهم المفضَّل.[28]

تكون الانحيازات في تفسير المُعتقد راسخة، بغضّ النظر عن مستوى الذكاء. خضع مُشاركون في تجربة إلى اختبار سات (اختبار التحاق بالجامعة يستخدم في الولايات المتحدة) لتقدير مستويات ذكائهم. قرأ المشاركون بعد ذلك معلومات متعلِّقة بمخاوف الأمان بالمَركبات، وتلاعبت التجارب ببيانات البلد المنشأ للسيّارة. أدلى مشاركون أمريكيّون برأيهم حول وجوب حظر السيارة بمقياس سِتّ نقاط، حيث كان رقم واحِد يعني "بالطبع نعم" وستة يعني "بالطبع لا." قيَّموا أولًا احتماليّة السماح لسيّارة ألمانيّة خطيرة بالسير في شوارع أمريكا، وسيّارة أمريكيّة خطيرة في شوارع ألمانيّا. اعتقد المشاركون أنَّ السيّارة الألمانيّة الخطيرة في شوارع أمريكا يجب أن تُحظر بشكل أسرع من السيّارة الأمريكيّة الخطيرة في شوارع ألمانيا. لم يكن هناك فارق في مستويات الذكاء فيما يتعلَّق بمدى سرعة حظر المشاركين لسيّارة.[21]

لا ينحصر التفسير الانحيازي في الموضوعات الهامَّة عاطفيًا. في تجربة أخرى، روي للمشاركين قصّة عن سرقة ما. كان عليهم قياس الأهمّيّة البرهانيّة لبعض الأقوال والإقرار مع أو ضد شخصيّة معيّنة كانت مسؤولة عن الحادثة. عندما افترضوا أنَّ تلك الشخصية مُذنبة، قيَّموا الأقوال التي تدعم ذلك الافتراض بأنها أكثر أهمّيّة من الأقوال المتعارضة معها.[29]

ذاكرة انحيازية

حتى إذا جمع الأشخاص الأدلَّة وفسّروها بطريقة حياديّة، فإنّهم يستمرّون في تذكُّرها انتقائيًا لدعم توقّعاتهم. يُدعى هذا التأثير "استرجاع انتقائي"، "ذاكرة التأكيد" أو "ذاكرة متحيّزة المرور".[30] تختلف النظريّات النفسيّة في توقّعاتها حول الاسترجاع الانتقائي. تتنبأ نظرية المخطط بأنَّ تخزين واسترجاع المعلومات المتوافِقة مع التوقُّعات المُسبقة سيكون أسهل من المعلومات غير المتوافِقة.[31] تُفيد بعض المقاربات البديلة بأنَّ المعلومات المفاجِئة تتمَيّز عن غيرها وبذلك يَسهُل تذكُّرها.[31] تأكَّدت توقّعات هاتين النظريّتين في تجارب مختلفة، ولم تتفوَّق نظريّة على الأخرى بشكل تامّ.[32]

في إحدى الدراسات، قرأ المشاركون ملف امرأة يصف مزيجًا من التصرفّات الانطوائيّة والانفتاحيّة.[33] ثُم كان عليهم تذكُّر أمثلة لانطوائها وانفتاحها. طُلِب من مجموعة أن يقيِّموا المرأة من أجل وظيفة أمينة مكتبة، بينما طُلِب من مجموعة ثانية أن يقيّموها من أجل وظيفة في مبيعات العقارات. كان هناك فارقًا ملحوظًا بين ما تذكَّرته هاتان المجموعتان، مجموعة "أمينة المكتبة" تذكَّرت أمثلة أكثر على الانطوائيّة، في حين أنّ مجموعة "المبيعات" تذكّرت تصرفّات أكثر انفتاحًا.[33] ظَهَر تأثير الذاكرة الانتقائيّة أيضًا في تجارب تتلاعب بمرغوبيّة أنواع الشخصيّات.[31][34] في إحدى تلك التجارب، عُرِضَت أدلّة على مجموعة من المشاركين تفيد بأنّ الأشخاص الانفتاحيّين أكثر نجاحًا من الانطوائيّين. وهناك مجموعة أخرى قيل لها العكس. في دراسة لاحقة -يبدو ظاهرياً أنّها غير مرتبطة بالدراسة السابقة- طُلِب منهم تذكُّر أحداث من حياتهم كانوا فيها انطوائيّين أو انفتاحيّين. قدَّمت كلّ مجموعة من المشاركين ذكريات أكثر تربطهم بنوع الشخصيّة المرغوب أكثر، وتذكَّروا تلك الأشياء بسرعة أكبر.[35]

يُمكن أيضًا للتَّغيُّرات في الحالات العاطفيّة أن تؤثِّر على استرجاع الذاكرة (الاستذكار).[36][37] في إحدى التجارب طُلب من المشاركين قياس مدى مشاعرهم حينما علِموا لأول مرة عن براءة أو جاي سيمبسون مِن اتهامات القتل المُسندة إليه.[36] وصفوا ردود أفعالهم العاطفية بخصوص الحُكم بعد المحاكمة بأسبوع، وبشهرين، وبسنة واحدة. أشارت النتائج إلى تغيُّر في تقييم المشاركين حول ذنب سيمبسون بمرور الوقت. لوحظ اقتران حدوث تغير في رأي المشاركين عن الحكم مع عدم التيقن من استذكارهم لمشاعرهم الأولية. في حين أنه عندما تذكُّروا ردّ فعلهم الأوّل وبعد شهرين وبعد عام كامل، تشابَهت التقييمات العاطفيّة الماضية كثيرًا مع الحالية. يُظهِر الأشخاص تحيّزًا ذاتيًا كبيرًا حين مناقشة آرائهم حول موضوعات مثيرة للجدل.[21] استرجاع الذاكرة وبناء الخبرات يخضعان لمراجعة مرتبطة بالحالات العاطفية الموافقة.

تبيَّن أنَّ الانحياز الذاتي يؤثِّر على دِقَّة استرجاع الذاكرة (الاستذكار).[37] في إحدى التجارب، قيَّم الأرامل مِن الجنسين شِدَّة الحزن الذي اختبروه بعدَ مضيّ فترة ستّة أشهر وفترة خمس سنوات من وفاة أزواجهم. لوحظ أنَّ المشاركين مرّوا بحزن بعد ستّة أشهر أكبر من الحزن بعد مرور خمس سنوات. لكن، عندما سُئلوا بعد خمس سنوات عن شعورهم بعد ستّة أشهر من وفاة الشخص المقرَّب إليهم، شدّة الحزن التي تذكَّروها ارتبطت بشكل كبير مع مستوى حزنهم الحالي. يبدو أن الأفراد يستخدمون حالتهم العاطفيّة الراهنة في تحليل المشاعر التي مرّوا بها وقت الأحداث الماضية.[36] يعاد تشكيل الذكريات العاطفيّة بواسطة الحالات العاطفيّة الحاليّة.

أوضحت إحدى الدراسات كيف يمكن للذاكرة الانتقائيّة أن تعزِّز الإيمان بوجود إدراك خارج الحواس.[38] عُرضَ على المؤيِّدين والمكذبين أوصاف لتجارب تخص الإدراك الحسي الفائق. قيل لنصف كل مجموعة أنَّ نتائج التجارب أيَّدَت وجود الإدراك الحسِّي الفائق، بينما قيل للآخرين أنّها لم تؤيّدها. في اختبار لاحق، تذكَّر المشاركون المعلومات بدقّة، إلا المؤيدين الذين قرأوا الأدلّة غير المؤيّدة. تذكَّرت تلك المجموعة معلومات أقلّ بشكل ملحوظ وبعضهم تذكَّر بالخطأ أنّ النتائج مؤيِّدة للإدراك الحسِّي الفائق.[38]

تأثيرات ذات علاقة

تضارُب الرأي

عندما يقوم أشخاص لديهم آراء متعارضة بتفسير معلومات جديدة بطريقة انحيازية، قد تتباعد آراؤهم بشكل أكبر. يُدعى ذلك "تضارُب الموقِف".[39] ظهر ذلك التأثير في تجربة تضمَّنت سَحب سلسلة من الكرات الحمراء والسوداء من إحدى سلّتين مغلقتين من "سلَّات البينغو". عَلِم المُشاركون أن هناك سَلَّة تحتوي على 60% كرات سوداء و40% كرات حمراء؛ والأخرى 40% سوداء و60% حمراء. القائِمون على التجربة نظروا إلى ما حدث حين سُحبت كرات بألوان متبادلة تباعًا، بتسلسل لا يُرجِّح أيًا من السَّلَّتين. بعد سحب كل كرة، طُلِب مِن المشاركين في إحدى المجموعات النطق بحكمهم عاليًا حول احتمالية سحب الكرات مِن سلَّة مُعيَّنة. زادت ثقة هؤلاء المشاركين مع كل سحبة متوالية- سواء اعتقدوا في البداية أن المصدر غالبًا هو السلة التي بها 60% كرات سوداء أو التي تحتوي على 60% كرات حمراء، وازداد تقديرهم للاحتمال. طُلِب مِن مجموعة أخرى مِن المشاركين التصريح بتقديرات الاحتمال فقط عند نهاية سلسلة مِن الكرات المسحوبة، وليس بعد كل كرة. لم يُظهروا تأثير التضارُب، مما يشير إلى عدم ضرورة حدوثه عندما يكون للأشخاص ببساطة مواقِفًا مختلفة، بل عندما يتمسَّكون بها بشدّة.[40]

أُجريت دراسة أقل تجريدًا وهي تجربة ستانفورد للتفسير الانحيازي حيث قرأ المشاركون ذوي الآراء القوية حول عقوبة الإعدام عن الأدِلَّة المختلطة للتجارب. تبيَّن أن آراء ثلاثة وعشرون بالمائة مِن المشاركين أصبحت أكثر تطرّفًا، وأنّ ذلك التحوّل الذاتي ارتبط بشدَّة مع مواقفهم الأوَّليَّة.[24] في تجارب لاحقة، تبيَّن أيضًا أنَّ آراء المشاركين أصبحت أكثر تطرّفًا في الاستجابة للمعلومات الغامضة. لكن، لم يظهر فارق كبير بالمقارنة بين مواقفهم قبل وبعد الأدِلَّة الجديدة، ممّا يشير إلى أنَّ التغيُّرات الذاتيّة قد لا تكون حقيقيّة.[27][39][41] وفقًا لتلك التجارب، استنتجت ديانا كون وجوزيف لاو أنَّ التضارُب ظاهرة حقيقيّة ولكن ليست محتومة إطلاقًا، بل تحدُث فقط في حالات قليلة جدًا. لقد وجدوا أنَّ ما أثاره ليس النظر للأدلّة المختلطة وحسب، بل مجرّد التفكير بالموضوع.[39]

رَأَى تشارلز تابر وميلتون لودج أنَّ نتائج فريق ستانفورد يصعُب تكرارها لأن الحُجج المستخدمة في التجارب اللاحقة كانت مجرَّدة ومحيِّرة للغاية ولا تثير ردّ فعل عاطفي. استخدمت دراسة تابر ولودج موضوعات حسّاسة مثل الحد من السلاح والتمييز الإيجابي.[27] وقاموا بقياس مواقِف مشاركيهم نحو تلك المسائل قبل وبعد قراءة حُجج جميع أطراف النقاش. أظهرت مجموعتان مِن المشاركين تضارُبًا في الموقِف: أصحاب الآراء القويّة المُسبقة وأصحاب المعرفة السياسية. في جزء مِن تلك الدراسة، اختار المشتركون مصادر المعلومات التي سيقرأونها مِن قائمة أعدَّها القائمون على التجربة. على سبيل المثال، تسنَّى لهم قراءة حُجج "الجمعية القومية للبندقية" و"ائتلاف بريدي ضد السلاح" حول الحدّ من السلاح. بالرغم من وجود تعليمات بالمساواة، فضَّل المشاركون غالبًا قراءة الحُجج المؤيّدة لمواقِفهم الحاليّة عن المعارضة لها. ارتبط هذا البحث الانحيازي عن المعلومات بشدّة مع تأثير التضارُب.[27]

"تأثير النتيجة العكسية" هو اسم للحالة عندما، تكون الأدِلَّة المتاحة مُعاكِسة لمُعتقداتهم، يُمكن للأشخاص رفض الأدِلَّة والتَّمسُّك برأيهم أكثر.[42][43] ابتكر تلك العبارة برندن نايهان وجيسون ريفلر.[44]

استمرار المعتقدات غير الموثوقة

يُمكن استخدام الانحيازات التأكيدية لتفسير سبب استمرار بعض المعتقدات عندما تختفي الأدلّة الأوَّليَّة عليها.[46] أظهرت سلسلة من التجارب ذلك التأثير الخاص بثبات ورسوخ المُعتقد باستخدام ما يسمَّى "نموذج الاستجواب". يقرأ المشاركون أدلّة مزيّفة لتكوين افتراض، يُقاس مدى تغيُّر موقِفهم، ثم يُكشَف الزيف تفصيليًا. ثم تُقاس مواقفهم مرّة أخرى للتأكُّد إذا عاد مُعتقدهم إلى وضعه السابق.[45]

هناك استنتاج شائع وهو أنّ بعض المُعتقدات الأوَّليَّة تبقى على الأقلّ حتّى بعد القيام باستجواب كامل.[47] في إحدى التجارب، وجب على المشاركين التفرقة بين رسائل الانتحار الحقيقيّة والمزيَّفة. كانت التغذية الراجعة عشوائية: حيث قيل للبعض أنَّهم قد أبلوا بلاءً حسنًا، بينما قيل لآخرين أنَّهم قاموا بأداء سيء. حتى بعد الاستجواب الكامل، ظلّ المشاركون متأثّرين بأجوبة التغذية الراجعة. إذ ظلُّوا يُفكِّرون أنَّهم أفضل أو أسوأ من المستوى المتوسط في ذلك النوع من المَهمَّات، بالاعتماد على ما قيل لهم في البداية.[48]

في دراسة أخرى، قرأ المُشاركون تقييمات للأداء في العمل لاثنين مِن رجال الإطفاء، بالإضافة إلى استجاباتهم نحو اختبار تفادِي المُخاطرة.[45] تلك البيانات الخيالية رُتِّبَت لتوضِّح وجود ارتباط سلبي أو إيجابي: قيل لبعض المشاركين أنَّ رجل الإطفاء المُخاطِر كان أفضل، بينما قيل لآخرين إنَّه جيد ولكن أقلّ مِن زميله مُتجنِّب المخاطِر.[49] حتى إن كانت دراسة الحالتين حقيقيّة، كانت لتمثِّل دليلًا ضعيفًا للغاية لاستنتاج حول أداء رجال الإطفاء بشكل عام. بالرغم من ذلك، وجد المُشاركون أنَّها مُقنِعة موضوعيًا.[49] عندما ظهر أنَّ دراسة الحالات خيالية وموضوعة، اختفى اعتقاد المشاركين بوجود رابط، لكن حوالي نصف التأثير الأصلي بقي موجودًا.[45] أكَّدت مقابلات المتابعة أنَّ المشاركين قد فهموا الاستجواب وأخذوه على محمل الجدّ. بدا أنَّ المشاركين قد وثقوا في الاستجواب، لكنّهم اعتبروا المعلومات غير الموثوقة غير هامّة لمُعتقدهم الشخصي.[49]

تفضيل المعلومات الأوَّليَّة

أوضحت التجارب أنَّ المعلومات تكون مُرجَّحة بشكل أقوى عندما تظهر أولًا ضمن سلسلة معلومات، حتى وإن كان الترتيب بلا أهمّيّة. على سبيل المثال، يُشَكِّل الأفراد انطباعًا أكثر إيجابية عن شخص وُصِفَ بأنه "ذكي، مجتهد، تلقائي، انتقادي، عنيد، حسود" من الانطباع المأخوذ عندما تُعرَض عليهم الكلمات ذاتها بترتيب معكوس.[50] يختلف التأثير غير المنطقي للأسبقيّة عن تأثير الأسبقيّة في الذاكرة حيث تترك العناصر الأولى في سلسلة من العناصر أثرًا أقوى في الذاكرة.[50] يتيح التفسير الانحيازي إيضاحًا لذلك التأثير: عند رؤية الدليل الأوَّل، يشكِّل الأشخاص افتراضًا فعّالًا يؤثّر على كيفيّة تفسيرهم لبقيّة المعلومات.[46]

استُخدِمَت رقاقات ملوّنة سُحِبَت فرضيًا من إناءين لتوضيح الأثر غير المنطقي للأسبقيّة، وقيل للمشاركين بالتجربة نمط توزيع الألوان بالإناءين، وطُلِبَ منهم تقدير احتماليّة سحب رقاقة معيّنة من أحد الإناءين.[50] في الواقع، ظهرت الألوان بترتيب مُسبق. رجَّحت أول ثلاثون سحبة الإناء الأول والثلاثون التالية رجَّحت الآخر.[46] كانت السلسلة محايدة إجمالًا لذا منطقيًا يعتبر الإناءين متساويين في الأرجحيّة. على الرغم من ذلك، بعد ستّين سحبة، فضَّل المشاركون الإناء الأوّل بناءً على أوّل ثلاثين سحبة.[50]

تضمَّنت تجربة أخرى عرضًا مرئيًا لشيء ما بصورة مشوّشة في باديء الأمر ثم تتّضح الرؤية قليلًا مع مرور الصور التالية للشيء نفسه.[50] بعد مرور كل صورة، طُلِبَ من المشاركون تحديد أقرب تخمين يُناسب ماهيّة ذلك الشيء. مَن قاموا بتخمين خاطيء التزموا بتخميناتهم، حتّى عندما اتَّضحت الصورة بشكل كافٍ ليتعرَّف المشاركون الآخرون على ذلك الشيء.[46]

ربط وهمي بين الأحداث

الربط الوهمي هو الميل لرؤية روابط غير موجودة بين مجموعة من البيانات.[51] اتَّضحت تلك النزعة للمرة الأولى في سلسلة من التجارب أٌجريت في أواخر ستينات القرن العشرين.[52] في إحدى التجارب، قرأ المشاركون مجموعة مِن الدراسات حول حالات نفسية، وتضمَّنت استجابات إلى اختبار بقعة الحبر لرورشاخ. رجَّح المشاركون أنَّ الرجال المِثليِّين من المجموعة انتهوا إلى رؤية أرداف، شروج أو أشكال جنسية غامِضة في بقع الحبر. في الواقع لقد كانت الحالات خيالية وأيضًا، في إحدى المحاولات، قد أٌعِدَّت التجربة خصيصًا بحيث يُستبعد تكوين الرجال المِثليِّين لتلك الصور.[51] تَوَصَّل عدد من المحلِّلين النفسيين في استطلاع للرأي إلى مجموعة الروابط الوهمية ذاتها بخصوص المِثليِّة الجنسيّة.[51][52]

سجَّلت دراسة أخرى الأعراض التي يمرّ بها مرضى التهاب المفاصل، وعلاقتها بأحوال الطقس على مدى فترة استمرّت 15 شهرًا. قال جميع المرضى تقريبًا أنَّ آلامهم مرتبطة بأحوال الطقس برغم أنَّ نسبة الارتباط في الواقع كانت معدومة.[53]

يُعَد هذا التأثير نوعًا من التفسير الانحيازي، مِن حيث تفسير أدلّة محايدة موضوعيًا أو مُعارِضة بطريقة تدعم المعتقدات الحاليّة. ويرتبط أيضًا بالانحيازات مِن حيث سلوك اختبار الفرضيَّة.[54] عند اتِّخاذ قرار إذا ما كان حدثان، كالمرض والطقس السيّء، مرتبطَين أم لا، يعتمد الناس بشدّة على عدد حالات توافُر الحدثين معًا: كما في ذلك المثال، مظاهر الألم والطقس السيّء معًا. ويعيرون انتباهًا قليلًا نسبيًا لأنواع الحالات الأخرى (عدم وجود ألم و/أو وجود طقس جيد).[55] وهذا يُعادِل الاعتماد على الاختبارات الإيجابيّة في اختبار الفرضيّة.[54] قد يعكس ذلك أيضًا الاسترجاع الانتقائي، حيث قد يشعر الناس بارتباط حدثين لأن تذَكُّر أوقات حدوثهما معًا يكون أسهل.[54]

فروق فردية

كان الانحياز الذاتي يُعتبَر في وقت ما مرتبطًا بقدر أكبر مِن الذكاء؛ لكن الدراسات أوضحت أنّ الانحياز الذاتي يمكن أنّ يتأثَّر بالقدرة على التفكير المنطقي بشكل أكبر من تأثُّره بقدرٍ مِن الذكاء.[56] قد يُسبِّب الانحياز الذاتي عدم القدرة على عَمَل تقييم فعَّال ومنطقي للجانب المُعارِض في نِقاش ما. أوضحت الدراسات أن الانحياز الذاتي هو غياب "انفتاح العقل الفعَّال،" أي البحث عن الأسباب التي قد تجعل فكرة أوَّليَّة تبدو مغلوطة.[57] إجْمالاً، يُفَعَّل الانحياز الذاتي بالدراسات التجريبية متمثّلًا في كمّيّة الأدلّة المُستخدَمَة لدعم جانب معين عند مقارنته بالجانب المضاد له.[58]

لقد توصَّلت دراسة إلى الفروق الفرديّة بخصوص الانحياز التأكيدي. تلك الدراسة تبحث في الفروق الفرديّة المُتَقَلِّبة والمكتسبة من خلال التعلُّم في سياق ثقافي. تَوصَّل الباحثون إلى فروق فرديّة هامّة في المناقشات. أشارت الدراسات إلى أهمّيّة الفروق الفردية مثل التفكير الاستنتاجي، وقُدرة التغلُّب على الانحياز للمعتقدات، الإدراك المعرفي، والتحكم بالأفكار في التنبؤ بالتفكير وتكوين الحُجج، والحُجج المضادة، والتفنيدات.[59][60][61]

هناك دراسة أجراها كريستوفر وولف وآن بريت بحثت أيضًا في آراء المشاركين حول "ما مكوّنات الحُجّة القويّة؟" وكيف يمكنها أن تكون مصدرًا للانحياز الذاتي الذي يؤثر على طريقة تكوين الفرد لحُجَجه الخاصة.[58] بحثت الدراسة في الفروق الفرديّة في بناء الحُجج وتطلّبت قيام المشاركين بكتابة مقالات. أُسنِد للمشاركين عشوائيًا مهمّة كتابة مقالة تدعم أو تنفي رأيهم بالحُجّة التي يحبّذونها في ظل توافر تعليمات معتدلة أو غير مقيّدة للبحث. حثَّت تعليمات البحث المعتدلة المشاركين على تكوين حُجّة متوازنة تتضمَّن المزايا والعيوب؛ أمَّا التعليمات الحُرة غير المقيّدة فلم تضع أيّة ضوابط حول كيفيّة تكوين الحُجّة.[58]

إجمالًا، كشفت النتائج أنّ تعليمات البحث المعتدلة أدَّت لزيادة ملحوظة في استخدام معلومات تتعارض مع آراء المشاركين. توضِّح تلك البيانات أيضًا أنَّ المُعتقد الشخصي لا يُعَدّ مصدرًا للانحياز الذاتي. ولكنّ المشاركون الذين يعتقدون أن الحُجج الجيّدة تستند إلى حقائق كانوا عُرضى للانحياز الذاتي أكثر من هؤلاء الذين لم يتّفقوا مع هذا المبدأ. تتوافق تلك الأدلّة مع الآراء المطروحة في مقالة بارون التي تزعم أن آراء الأشخاص حول التفكير الجيّد يمكنها التأثير على كيفيّة تكوين الحُجج.[58]

تاريخه

ملاحظات بسيطة

قبل الأبحاث النفسيّة حول الانحياز التأكيدي، لوحظت تلك الظاهرة بشكل قَصصي على مدى التاريخ. بدايةً من المؤرّخ الإغريقي ثوسيديديس (460 ق. م.- 395 ق. م.)، الذي كتب عن الخيانة المُضَلَّلَة في الحرب البيلوبونيسية، "... لأنها عادة البشر أن يثقوا بالأمل الواهي في رغباتهم، وأن يستخدموا المنطِق الأُحادي لاستبعاد ما لا يحلو لهم.""[62] ذَكَرَها الشاعر الإيطالي دانتي أليغييري (1265- 1321) في كتابه الشهير الكوميديا الإلهية، حيث يقوم القديس توما الأكويني بتحذير دانتي عند لقائهما في الجنة، "الرأي- المتسرِّع- غالبًا ما يميل للجانب الخاطئ، ثم تقوم مشاعر الشخص نحو آرائه الخاصّة برَبط عقله وتقييده." [63] ذكر الفيلسوف والعالِم الإنجليزي فرانسيس بيكون (1561-1626)،[64] في كتابه نوڤوم أورجانوم Novum Organum أنَّ التقييم الانحيازي للأدِلَّة أدَّى إلى وجود "كلّ الخرافات سواءً كانت في التَنجيم، الأحلام، الطالِع، الأحكام الإلهيّة أو ما شابه ذلك".[65] فكتب:

الإدراك البشري في حالة تَبَنِّي رأي ما... يأتي بجميع الأشياء الأخرى التي تدعمه وتؤيّده. وبالرغم من وجود عدد أكبر وكَمّ مِن الأدِلَّة المُمكن إيجادها على الرأي الآخر، فإنّه إمَّا يلجأ لإهمالها أو احتقارها، وإمَّا يعترف بوجودها إلى حدّ ما ويضعها جانبًا أو يرفضها.[65]

كَتَب الروائي الروسي ليو تولستوي في مقالتة "ما هو الفن؟"، الآتي،

أعلم أن معظم الرجال- ليس فقط الذين يُعتَبَرون أذكياء، ولكن حتّى مَن هم في غاية الذكاء، وقادرون على فهم مُعظَم المشكلات العلميّة، والحسابيّة، أو الفلسفيّة- نادرًا ما يَلحظون حتى أبسط وأوضح الحقائق إن كانت تُجبرهم على الاعتراف بزيف استنتاجات قد توصّلوا إليها، وربما يجدون صعوبةً أكبر- إن كانت نتائج يفخرون بها، وعَلَّموها لآخرين، وأسّسوا عليها حياتهم.[66]

بحث واسون حول اختبار الفرضية

ابتكر مصطلح "الانحياز التأكيدي" العالِم النفساني الإنجليزي بيتر واسون.[67] مِن أجل تجربة نُشِرَت عام 1960، قام واسون بتحدِّي المشاركين لتحديد قاعِدة تنطبق على ثلاثيّات من الأرقام. في البداية، قيل لهم أنَّ (2، 4، 6) تلائِم القاعدة. استطاع المشاركون إنتاج ثلاثيّات بأنفسهم وأخبرهم القائم على التجربة إذا ما كان كُلٌّ مِن الثلاثيّات يتوافق مع القاعدة أم لا.[68][69]

بينما كانت القاعدة الحقيقيّة ببساطة "أيّ تسلسل تصاعدي"، واجَه المشاركون صعوبة بالغة في إيجادها، وفي الغالب ذكروا قواعد أكثر تفصيلًا، على سبيل المثال "الرقم الأوسط يُمثِّل مُتَوَسِّط الرقم الأوّل والأخير".[68]". بدا أنَّ المشاركون يميلون لتجربة الأمثلة الإيجابيّة- أيْ الثلاثيات التي تَتَّبِع القاعدة التي افترضوها. على سبيل المثال، إذا ظنّوا أنَّ القاعدة هي، " كُل رقم يَزيد اثنين عن السابِق له"، يَرَجَّح اقتراحهم لثلاثيّة تلائم تلك القاعدة، مِثل (11، 13، 15) على اقتراحهم لأَخرى تُخالفها، مِثل (11، 12، 19).[70]

اتَّفق واسون مع فكرة قابلية التكذيب، ووفقًا لها إنَّ الاختبار العِلمي لِفَرضيّة ما، هو محاولة جدِّية لتكذيبها. وقد فسَّر نتائجه بأنها توضِّح تفضيل التوكيد على التكذيب، ومِن هنا أتى مصطلح " انحياز تأكيدي".[ملحوظة 4][71] استخدم واسون أيضًا الانحياز التأكيدي لتفسير نتائج تجربته مسألة الاختيار.[72] يُعطَى في تلك المسألة المشاركين معلومات جزئية عن مجموعة من الأشياء، ويجب عليهم تحديد المعلومات الباقية التي يحتاجونها لمعرفة إذا ما كانت إحدى القواعد الشَرطيّة ("إذا وُجِد أ، يتحقق ب") تنطبق على تلك الأشياء أم لا. اتَّضح تكرارًا أنَّ أداء الأفراد يكون سيئًا في عِدة أنماط مِن ذلك الاختبار، حيث يقومون في مُعظم الحالات بتجاهُل المعلومات التي قد تنفي القاعِدة.[73][74]

نقد كلايمان وها

وَرَد في بحث قام به جوشوا كلايمان ويونج-وون ها أنَّ تجارب واسون لم توضِّح انحيازًا نحو التأكيد. بل، فسَّر كلايمان وها النتائج بأنها ميل نحو ابتكار اختبارات تتوافق مع الافتراض السائد.[75] واطلقوا على ذلك اسم "إستراتيجية الاختبار الإيجابي".[8] تُعتَبر تلك الإستراتيجية مثالًا لإرشادات لاستدلال: طريق مختصر بتركيز الفِكر على نقطة دون أخريات ويُعتبر مَنقوصاً ولكن يَسهُل القيام به.[76] استخدَم كلايمان وها الاحتمال الافتراضي (احتمالية بايز) ونظرية المعلومات بمثابة معايير اختبار الفرضيَّة، بدلًا من قابليّة التكذيب التي استخدمها واسون. وفقًا لتلك الأفكار، ينتُج عن كُل إجابة على سؤال كمّيَّة مختلفة مِن المعلومات، تعتمد على المُعتقدات السابِقة للفَرد. بالتالي مِن المُتوَقَّع أنَّ الاختبار العِلمي للافتراض ينتج عنه أكبر قَدر مِن المعلومات. بما أنَّ مُحتوى المعلومات يعتمد على الاحتمالات الأوَّلية، فالاختبار الإيجابي يمكنه أن يكون غنيّاً بالمعلومات أو لا. ذَكَر كلايمان وها أنَّه عِند تفكير الأشخاص في المشكلات الواقعية، فإنَّهم يبحثون عن إجابات مُحدَّدَة ذات احتماليّة أوَّليّة ضئيلة. في تلك الحالة، عادةً ما يَنتج عن الاختبارات الإيجابيّة معلومات أكثر مِن الاختبارات السلبيّة.[13] على الرغم مِن ذلك، في مسألة اكتشاف القاعِدة لِواسون تكون الإجابة- ثلاثة أرقام بترتيب تصاعدي- في غاية العموم، لذا لا يُرَجَّح أن ينتج عن الاختبارات الإيجابيّة إجابات وافرة المعلومات. دَعَم كلايمان وها تحليلهما بالقيام بتجربة تستَخدِم الرموز "DAX" و"MED" محل " تلائِم القاعدة" و" لا تلائِم القاعدة". وتَجنَّب ذلك الإشارة إلى أنَّ الهدف هو إيجاد قاعدة الاحتمال الضعيف. لاقى المشاركون نجاحًا أكبر بكثير في تلك النسخة مِن التجربة.[77][78]

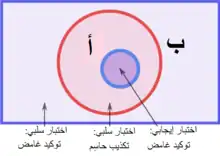

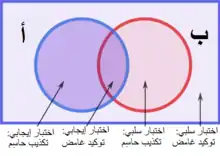

إن كانت القاعِدة الأساسية (ب) تشمَل الافتراض الحالي (أ)، فالاختبارات الإيجابية (التي تبحث إذا كان أ يتوافَق مع ب) لن تستنتج أنَّ الافتراض خاطيء. |

إن كانت القاعِدة الأساسية (ب) تتداخل مع الافتراض الحالي (أ)، فيمكن لاختبار سلبي أو اختبار ايجابي أن يَنفي أ. |

عندما يكون الافتراض السائِد (أ) يتَضمَّن القاعدة (ب) فالاختبارات الإيجابية هي الطريقة الوحيدة لنَفي أ. |

في ضوء ذلك النقد وغيره، انتقل مِحوَر البحث بعيدًا عن التأكيد مقابِل التَكذيب ليبحث إذا كان الناس يختبرون الفرضيَّات بطريقة ينتج عنها معلومات مفيدة، أم بطريقة لا تُنتِج معلومات لكن إيجابيّة. دَفَع البحث عن انحياز تأكيدي "حقيقي" علماء النفس للنظر إلى نِطاق أوسع مِن التأثيرات في كيفيّة استيعاب الأشخاص للمعلومات.[79]

تفسيرات

يوصَف الانحياز التأكيدي غالبًا بأنّه نتيجة إستراتيجيّات تلقائيّة، غير مقصودة وليس خِداعًا مُتعمَّدًا.[14][80] طِبقًا لروبرت ماكون، تحدُث مُعالَجة البيانات المُتحيِّزة في مُعظم الأحيان عن طريق مزيج مِن كلا الآليات " الباردة" (المعرفيّة) و" الساخِنة" (المُحَفَّزَة).[81]

تقوم التفسيرات الإدراكيّة للانحياز التأكيدي على وجود حدود لقُدرة الأشخاص على التعامُل مع المهمّات المُعقَّدة، والطُرق المُختصَرة، تُدعى إرشادات الاستدلال، التي يستخدمونها.[82] على سبيل المثال، يُمكِن أن يحكُم الأشخاص على دِقَّة الأدلة باستخدام تَوافُر إرشادات الاستدلال- أيْ سهولة مجيء فكرة معيَّنة في الذَّهن.[83] يُمكن أيضًا ألَّا يستطيع الأشخاص التركيز سوى على فكرة واحدة في لحظة معيّنة، لذا يواجهون صعوبة في اختبار فرضيَّات بديلة في الوقت ذاته.[84] تُعتبر إستراتيجية الاختبار الإيجابي طريقة أخرى للاستدلال عَرَّفها كلايمان وها، حيث يَختبِر الأشخاص فرضيَّة من خلال دراسة الحالات التي يتوقّعون فيها توافُر صِفة أو وقوع حدث ما. تتفادى تلك الطريقة المهمّة الشاقَّة أو المستحيلة في التعامُل مع مدى تَمَيُّز كُلٌ مِن الأسئلة المُحتَمَلة. مع ذلك، لا يُعتَمَد عليها عموماً، حتى يُمكن للأشخاص تجاهُل تحَدِّيات قد تواجِه مُعتقداتهم الحاليّة.[13][85]

تتضمَّن التفسيرات التحفيزيّة تأثير الرَّغبة على المُعتقدات، وذلك يُدعى أحيانًا " التفكير الرغبوي".[86][87] مِن المُتَعارَف عليه أنَّ الناس يُفَضِّلون الأفكار السَّارّة على المزعِجة بِطُرُق عديدة: ذلك يُدعى " مبدأ بوليانا".[88] عِند تطبيق ذلك على الحُجَج أو منابِع الأدِلَّة، فإنه قد يُفسِّر سبب أنَّ النتائج المرغوبة هي التي يؤمِن بِصحّتها الأشخاص في غالِب الأمر.[86] وفقًا لتجارب تقوم بالتلاعُب بجاذبيَّة النتيجة، إنَّ الأفراد يضعون معايير عالية للأدلّة غير المُستساغة ومعايير مُنخفِضة للأفكار المُفَضَّلة. بِمعنى آخر، يَسألون، "هل يُمكنني تَصديق ذلك؟" لبعض الاقتراحات و"هل يجب عَلَيَّ تَصديق ذلك؟" لِأُخرى.[89][90] برغم أنَّ اتساق الأفكار سِمة مَرغوبة في المواقِف، فالاندفاع الشديد نحو تناغم الآراء يُحتمل أن يكون مصدرًا آخر للانحياز لأنه قد يَمنَع الأشخاص من التقييم الحيادي للمعلومات الجديدة والمفاجِئة.[86] جمع أخصَّائي عِلم النفس الاجتماعي زيفا كوندا بين النظريّة الإدراكيّة والتحفيزيّة، ويرى أنَّ التَّحفيز يولِّد الانحياز، لكن العوامل الإدراكية تحدِّد حجم ذلك التأثير.[91]

تفتَرِض التفسيرات المَبنيَّة على تحليل التكلفة والفائدة أنَّ الأشخاص لا يقومون فقط باختبار الفرضيَّات بطريقة لا مُباليّة، بل يُقيِّمون عواقِب الأخطاء المختلفة. زعم جيمس فريدريك باستخدام أفكار مِن عِلم النفس التطوُّري، أنَّ الأفراد لا يَهدفون بشكل أساسي إلى العثور على الحقيقة عِند اختبار الفرضيَّات، بل يُحاولون تجنُّب الأخطاء وخِيمة العواقِب.[92] على سبيل المِثال، قد يسأل أرباب العمل أسئلة أُحادية الجانب في مقابلات العمل لأنَّهم مهتمُّون باستبعاد المرشَّحِين غير الملائمين.[93] يَفترِض تَعديل ياكوف تروب وأكيفا ليبرمان لتلك النظرية أنَّ الناس يقارنون بين نوعيّ الخطأ المُختلفَين: قبول افتراض خاطئ أو رَفض افتراض صحيح. على سبيل المثال، شخص يَستهين بمِقدار صِدق صاحبه قد يُعامِله أو يُعامِلها بارتياب وبذلك يهدِم صداقتهما. وقد تكون المبالغة في تقدير صِدق الصديق مُكلِّفة أيضًا، ولكن أقل. في تلك الحالة، سيكون من المنطقي ابتغاء، تقييم أو تَذَّكُّر أدلَّة على صدقهم بطريقة متحيِّزة.[94] عِندما يُعطي شخص انطباعًا أوَّليًا بكونه انطوائي أو اجتماعي، تُعتَبر الأسئلة المتوافِقة مع ذلك الانطباع أكثر تعاطُفًا ووجدانية.[95] يُوحي ذلك بأنَّه عِند التحدث مع شخص يبدو انطوائيًا، يُعتبر طَرح سؤال مِثل " هل تشعر بالحرج في المواقف الاجتماعية؟" دليلًا على امتلاك مهارات اجتماعية أفضل مِن سؤال مِثل "هل تُحِبّ الحفلات الصاخِبة؟" وقد أكَّدت دراسة حول كيفيّة تعارف طلاب الجامِعة على الآخرين على الرابط بين الانحياز التأكيدي والمهارات الاجتماعية. قام الطُلَّاب المراقبون لذاتهم بشِدَّة، الذين يتَّسِمون بحساسية تجاه البيئة المحيطة والمعايير الاجتماعية، بتوجيه أسئلة ملائمة عِند مُقابَلة مُوظَّف عالِ المرتبة أكثر مِن حين التعرُّف على أحد زملائهم.[95]

قام علماء النَفس جينيفر ليرنر وفيليب تيتلوك بالتفريق بين نوعين مُختلفين مِن آليات التفكير. الفِكر الاستطلاعي الذي يهتم بوِجهات نَظَر متعدِّدة ويحاول توقُّع كل الاعتراضات المُحتَمَلة على موقِف معيَّن، بينما الفِكر التأكيدي الذي يسعى إلى تبرير وِجهة نَظَر مُعيَّنة. يقول ليرنر وتيتلوك إنَّه عندما يَتوقَّع الناس تبرير مواقفهم أمام آخرين يَعرفون آرائهم بالفِعل، سوف يميلون لتَبَنِّي وجهة نظر مُماثلة لأولئك الأشخاص، ثم يقومون باستخدام الفِكر التأكيدي لدعم مِصداقيَّتهم الخاصَّة. مع ذلك، إن كانت الأطراف الخارجية تبالِغ في العدائية أو النقد، سوف يبتعد الناس عن التفكير بِرُمَّته، ويقومون ببساطة بتأكيد آرائهم الشخصية دون تبرير.[96] يقول ليرنر وتيتلوك إنَّ الناس يَدفعون أنفسهم للتفكير النَّقدي والمنطقي فقط حين يَعلمون مُقَدَّمًا أنَّهم سيضطّرون لشرح موقِفهم أمام آخرين يتَّسمون بالثقافة، يهتمَّون بصِدق بالحقيقة، ويقولون آراء ليست معروفة مُسبقًا.[97] ويعتقدان أنَّ مُعظم الناس يستخدمون الفِكر التأكيدي في مُعظم الأحيان، لأنَّ تلك الحالات نادرة الحدوث.[98]

العواقب

في المجال المالي

قد يقود الانحياز التأكيدي المستثمرين ليشعروا بثقة مبالغة، في ظل تجاهُل أدلَّة تشير إلى أن مخطّطاتهم ستسبِّب خسارة المال.[6][99] في دراسات حول بورصة الرهان السياسي، جنى المستثمرون مالًا أكثر عندما قاوموا الانحياز. على سبيل المثال، المشاركون الذين فسَّروا أداء مرشَّح في مناظرة بحياديّة وليس بانحيازيّة كانوا غالبًا ما يربحون.[100] لمحاربة تأثير الانحياز التأكيدي، يُمكن للمستثمرين تبَنِّي وِجهة نظر مُعاكِسة "جدلًا".[101] بإحدى الطرق يتخيّل رجال الأعمال انهيار استثماراتهم ويسألون أنفسهم لماذا قد حدث ذلك.[6]

في مجال الصحّة البدنيَّة والعقليَّة

يلوم عالِم النفس رايموند نيكرسون الانحباز التأكيدي على أنه سبب العمليّات الطبِّيّة الفاشلة التي أجريت لسنوات قبل اكتشاف علم الطب.[102] إذا تعافَى مريض، تَعتَبر السلطات الطبِّيّة العلاج ناجحًا، بدلًا مِن البحث عن تفسيرات بديلة مِثل مرور المرض بدورته الطبيعية.[102] يُعَد الإدراك الانحيازي مساعِدًا على حدوث الجاذبية العصرية نحو الطب البديل، الذي اقتنع أنصاره بالدليل القَصَصِي القاطِع ولكنهم يوجِّهون نحو الأدلّة العِلمية نَقدًا شديدًا.[103][104][105]

قام آرون ت.بيك بتطوير العِلاج الإدراكي في أوائل ستّينات القرن العشرين وأصبح أسلوبًا رائِجًا.[106] وفقًا لِبيك، الاستيعاب الانحيازي للمعلومات يُعَد مساعِدًا على الاكتئاب.[107] تُعلِّم وجهة نظره الناس معامَلة الأدلَّة بحياديّة، بدلًا مِن دعم وجهات نظر سلبيّة انتقائيًا.[64] اتَّضح أيضًا أنَّ الرهاب والتوهُّم المرضي يتضمَّنان انحيازًا تأكيديًا نحو معلومات خَطِرة.[108]

في مجال السياسة والقانون

يعتقد نيكرسون أنَّ التفكير ضِمن السياق القضائي والسياسي يتَّصف أحيانًا بالانحياز لا شعوريًا، بتفضيل النتائج التي استقرَّ إليها القُضاة وهيئات المحلّفين أو الحكومات بالفِعل.[109] بما أنَّ المُحاكمات أمام هيئة المحلّفين قد تكون معقَّدة، ويتَوصَّل أعضاء هيئة المحلّفين إلى قرارات مُتعلِّقة بالحُكم في بادئ الأمر، يكون مِن المنطقي توقُّع وجود تأثير تضارُب المواقف. اتَّضح التنبؤ بأنَّ المحلّفين سيصبحون أكثر تطرّفًا في آرائهم كُلَّما اطَّلعوا على أدِلَّة أكثر في تجارب تتضمَّن محاكمات صُوريَّة.[110][111] يتأثَّر كِلا نظاميّْ التَّمحيص والمغارمة في العدالة الإجرامية بالانحياز التأكيدي.[112]

يُمكِن أن يساعِد الانحياز التأكيدي على خَلق أو احتدام الصراعات، بدايًة مِن المُشاحنات حتى الحروب: بتفسير الأدلّة لصالِحهم، يُمكن أن يُصيب كُل فريق شعور بالثقة المُفرِطة بأنَّ موقِفه هو الأقوى.[113] مِن ناحية أخرى، يُمكن أن يَنتُج عن الانحياز التأكيدي تجاهُل أو سوء فهم بَوادِر صِراع وَشيك. على سبيل المثال، ناقش علماء النفس ستيوارت ساذرلاند وتوماس كيدا ظهور الانحياز التأكيدي على القائد البحري هازباند أي.كيمل عِند ظهور أولى مؤشِّرات الهجوم الياباني على ميناء بيرل هاربر.[73][114]

تّوصَّلَت دراسة استمرَّت عِقدين مِن الزمان قام بها فيليب تيتلوك حول المثقَّفين سياسيًا إلى أنَّه، إجمالًا، كانت تنبؤاتهم مجرَّد حظ. قسَّم تيتلوك الخبراء إلى "ثعالِب" يقومون بافتراضات متعدِّدة، و"قنافذ" أكثر حسمًا. بوجه عام، القناقذ كانت أقل دقَّة بكثير. اعتبَر تيتلوك الانحياز التأكيدي مسؤولًا عن فشلهم- خصوصًا، عدم قدرتهم على الاستفادة مِن المعلومات الجديدة المُناقِضة لنظريّاتهم الحالية.[115]

زعم الدِّفاع في محاكمة ديفيد كام في جريمة القتل عام 2013، أنَّ السبب وراء اتِّهام كام بجرائم قتل زوجته وطفليه هو الانحياز التأكيدي خلال التحقيق.[116] أُلقي القبض على كام بعد ثلاثة أيّام مِن وقوع الجرائم بناءً على أدِلَّة مغلوطة. بالرغم مِن اكتشاف أنَّ كل الأدلة تقريبًا في الإفادة كانت غير دقيقة وغير موثوقة، لم يتم إسقاط التُّهم الموجَّهة ضِده.[117][118] وُجِدت لاحقًا في مسرح الجريمة سُترة عُثِر فيها على الحمض النووي لجاني مُدان، ولقبه في السجن، ورقمه في المؤسسة الإصلاحية.[119] بحث المحقِّقون عن الحمض النووي الخاص بِكام على السُترة، لكنهم لم يقوموا بالتحقيق في الأدلة الأخرى الموجودة عليها ولم يتم فحص الحمض النووى الآخر إلا عقب مرور خمس سنوات على وقوع الجريمة.[120][121] عندما اكتُشِف المُشتبه به الثاني، قام أعضاء النيابة باتِّهامهما بالاشتراك في المؤامرة لتنفيذ الجريمة بالرغم مِن عدم وجود أدلة تربط بين الرَّجلين.[122][123] ظهرت براءة كام فيما بعد مِن جرائم القتل.[124]

في مجال خوارق الطبيعة

أحد عوامل الجذب نحو القراءات الروحية المزعومة هو أنَّ المستمعين يطبّقون الانحياز التأكيدي الملائم للعبارات الروحية على حياتهم الخاصة.[125] يقوم الوسيط الروحاني باستخدام عدد كبير مِن العبارات الغامِضة في كل جلسة، وذلك يُعطي العميل فرص أكثر لإيجاد ما يناسبه. تلك هي إحدى التقنيّات الخاصّة بقراءة الشخصيّات، التي يستطيع بها الوسيط أن يقوم بقراءة مُبهرة دون معلومات مُسبقة عن العميل.[125] قارَن المحقِّق جيمس راندي مخطوطة لقراءة مع تقرير عميل عمَّا قاله الوسيط الروحاني، ووجد أنَّ العميل قام باسترجاع "أهم الأحداث" بأسلوب انتقائي قوي.[126]

يوجد مثالٌ مدهشٌ على الانحياز التأكيدي في عالم الواقِع، يذكر نيكرسون التنجيم الهرمي: وهو محاولة إيجاد معنى في تناسُب أبعاد الأهرام المصرية.[127] هناك مقاسات طولية مختلفة كثيرة يُمكن أن تكون موجودة، على سبيل المثال، في هرم الجيزة الأكبر وهناك طرق عديدة لدمجها والتلاعُب بها. لذا إنَّه تقريبًا أمر حتمي أنَّ الأفراد الذين ينظرون لتلك الأرقام بشكل انتقائي سوف يجدون ظاهريًا توافُقات مُبهرة، على سبيل المثال مع أبعاد الأرض.[127]

في مجال العِلم

السِّمة التي تميِّز التفكير العلمي هي البحث عن أدلَّة للتكذيب بجانب أدلَّة الإثبات.[128] مع ذلك، قاوَم العلماء في عديد مِن المرَّات على مدى تاريخ العِلم، الاكتشافات الحديثة مِن خلال التفسير الانتقائي أو تجاهُل البيانات غير المرغوبة.[128] أوضحت أبحاث سابقة أنَّ تقييم جودة الدراسات العلميّة يبدو خاضعًا بشكل ملحوظ للانحياز التأكيدي. ثبت مِرارًا أنَّ العلماء يُقيِّمون الدراسات ذات النتائج المُتوافقة مع مُعتقداتهم المُسبقة بطريقة أفضل مِن التي تختلف نتائجها عن مُعتقداتهم السابقة.[80][129][130] مع ذلك، إن فرضنا أنَّ سؤال البحث ذو أهمية، والنمط التجريبي مناسِب والبيانات موصوفة بوضوح وشموليَّة، سوف تكون النتائج هامّة للمجتمع العلمي ولا يجب النظر إليها بتحامُل، بِصرف النظر عن توافُقها مع التنبّؤات النظرية الحاليّة.[130]

في سياق البحث العلمي، يُمكن للانحياز التأكيدي تأييد نظريّات أو برامج بحثيّة مُقابل الأدلّة غير الملائِمة أو حتّى المتناقِضة؛[73][131] لقد تأثَّر مجال عِلم ما وراء النفس بشكل ملحوظ.[132]

قد يؤثِّر الانحياز التأكيدي لدى القائِم على التجربة على ماهيّة البيانات الناتجة. قد تكون البيانات التي تتعارض مع توقُّعات مَن يُجري التجربة عُرضى أكثر للاستبعاد باعتبارها غير دقيقة، مما يولِّد تأثير انحياز النشر. لمحاربة تلك النزعة، يعمَل التمرين العلمي على تعليم طُرُق مَنع الانحياز.[133] على سبيل المثال، يهدف تصميم التجارب المنضبطة المعشّاة (مع مراجعتها المنهجية) إلى تقليل مصادر الانحياز.[133][134] تُخفِّف العملية الاجتماعية الخاصة بمراجعة الأقران تأثير انحيازات العلماء الفرديَّة،[135] حتى إن كانت عملية مراجعة الأقران مشكوك في ميلها للانحيازات.[130][136] لذا قد يؤثر الانحياز التأكيدي سلبًا على التقييم الموضوعي للنتائج غير المتوافِقة، حيث أنَّ الأفراد المتحيِّزين قد يعتبروا أنَّ الأدلة المُعارِضة ضعيفة مِن حيث المبدأ وقليلًا ما يفكرون جدِّيًا في مراجعة مُعتقداتهم.[129] يُلاقي العلماء المُبدعون مقاومة مِن المجتمع العلمي في غالِب الأمر، والأبحاث التي تقدِّم نتائج مثيرة للجدل تُلاقي باستمرار نقدًا لاذعًا مِن الأقران.[137]

بالنسبة لصورة الذات

حدَّد أخصَّائيو عِلم النفس الاجتماعي اتجاهان للطريق الذي يسعى الأشخاص فيه إلى معرفة أو تفسير معلومات عن أنفسهم. إثبات الذات هو الرغبة في دعم صورة الذات الحاليّة وتحفيز الذات هو السعي لردود الأفعال الإيجابيّة. يتحقَّق كلاهما مِن خلال الانحياز التأكيدي.[138] في التجارب التي يتلقَّى فيها للناس ردود أفعال تتعارَض مع صورتهم الذاتيّة، يكون احتمال ميلهم إليها أو تذكُّرها ضئيلًا على عكس الوضع في حال تلقِّيهم ردود أفعال تؤكّد رؤيتهم لذاتهم.[139][140][141] يقوم الأشخاص بتقليل أثر تلك المعلومات عن طريق تفسيرها بأنّها غير موثوقة.[139][142][143] أوضحت التجارب المشابِهة تفضيل ردود الأفعال الإيجابيّة، ومَن يقولونها، على ردود الأفعال السلبيّة.[138]

انظر أيضًا

ملحوظات

- ابتكر ديفيد بيركنز (عالِم وِراثيات) مصطلح "الانحياز الذاتي" مشيرًا إلى تفضيل الشخص لرؤية الأمور من "زاويته الخاصة". (Baron 2000, p. 195)

- توكمان (1984) وصفت أحد أوجه الانحياز التأكيدي بالعمل في تبرير السياسات التي تلتزم بها حكومة ما: "بمجرد اتِّباع سياسة ما وتطبيقها، تكون كلّ الأفعال التالية موجَّهة لتبريرها" (ص. 245)

في سياق مناقشة سياسة جذبت الولايات المتحدة نحو الحرب في فيتنام وجعلت الجيش الأمريكي يخوض الحرب لمدة ستة عشر عامًا بالرغم من وجود أدلّة لا تُحصى على كونها قضيّة خاسرة منذ البداية، ذَكَرت توكمان:

إنَّ التشبُّث بالرأي، مصدرًا لخِداع الذات ويَلعب دورًا كبيرًا في الحكومة. يتضمَّن تقييم موقِف وفقًا لمفاهيم مُسبقة ثابتة ويتجاهَل أو يرفض أيَّة إشارات مُعارِضة لها. إنَّه التصرُّف حسب الرغبة وعدم السماح للنفس بالالتفات نحو الحقائق. يتلخَّص الأمر في مقولة مؤرّخ عن فيليب الثاني ملك إسبانيا، الذي يَفوق كل الملوك في التشبُّث بالرأي: "لم تستطِع أيَّة تجربة فشل لسياسته أن تُثنيه عن يقينه بالتفوّق المُطلق." (ص. 7)

تُعتبَر الحماقة، في اعتقادها، إحدى صور خداع الذات ومن سماتها "الإصرار على مفهوم راسِخ بغضّ النظر عن الأدلّة المُعارِضة له." (ص. 209) - ""أثر الاستيعاب" مصطلح آخر يشير إلى التفسير الانحيازي للأدلة. (Risen & Gilovich 2007, p. 113)

- واسون استخدم أيضًا مصطلح "انحياز الإثبات". (Poletiek 2001, p. 73)

مراجع

- Plous 1993، صفحة 233

- Nickerson, Raymond S. (يونيو 1998). "Confirmation Bias: A Ubiquitous Phenomenon in Many Guises". Review of General Psychology. 2 (2): 175–220. doi:10.1037/1089-2680.2.2.175. الوسيط

|CitationClass=تم تجاهله (مساعدة) - Tuchman, Barbara (1984). The March of Folly: From Troy to Vietnam. New York: Knopf.

- Darley, John M.; Gross, Paget H. (2000), "A Hypothesis-Confirming Bias in Labelling Effects", in Stangor, Charles, Stereotypes and prejudice: essential readings, Psychology Press, p. 212, (ردمك 978-0-86377-589-5), OCLC 42823720

- Risen & Gilovich 2007

- Zweig, Jason (November 19, 2009), "How to Ignore the Yes-Man in Your Head", Wall Street Journal (Dow Jones & Company), retrieved 2010-06-13

- Nickerson 1998, pp. 177–178

- Kunda 1999, pp. 112–115

- Baron 2000, pp. 162–164

- Kida 2006, pp. 162–165

- Devine, Patricia G.; Hirt, Edward R.; Gehrke, Elizabeth M. (1990), "Diagnostic and confirmation strategies in trait hypothesis testing", Journal of Personality and Social Psychology (American Psychological Association) 58 (6): 952–963, doi:10.1037/0022-3514.58.6.952, ISSN 1939-1315

- Trope, Yaacov; Bassok, Miriam (1982), "Confirmatory and diagnosing strategies in social information gathering", Journal of Personality and Social Psychology (American Psychological Association) 43 (1): 22–34, doi:10.1037/0022-3514.43.1.22, ISSN 1939-1315

- Klayman, Joshua; Ha, Young-Won (1987), "Confirmation, Disconfirmation and Information in Hypothesis Testing" (PDF), Psychological Review (American Psychological Association) 94 (2): 211–228, doi:10.1037/0033-295X.94.2.211, ISSN 0033-295X, retrieved 2009-08-14

- Oswald & Grosjean 2004, pp. 82–83

- Kunda, Ziva; Fong, G.T.; Sanitoso, R.; Reber, E. (1993), "Directional questions direct self-conceptions", Journal of Experimental Social Psychology (Society of Experimental Social Psychology) 29: 62–63, ISSN 0022-1031 via Fine 2006, pp. 63–65

- Shafir, E. (1993), "Choosing versus rejecting: why some options are both better and worse than others", Memory and Cognition 21 (4): 546–556, doi:10.3758/bf03197186, ببمد 8350746 via Fine 2006, pp. 63–65

- Snyder, Mark; Swann, Jr., William B. (1978), "Hypothesis-Testing Processes in Social Interaction", Journal of Personality and Social Psychology (American Psychological Association) 36 (11): 1202–1212, doi:10.1037/0022-3514.36.11.1202 via Poletiek 2001, p. 131

- Kunda 1999, pp. 117–118

- Albarracin, D.; Mitchell, A.L. (2004). "The Role of Defensive Confidence in Preference for Proattitudinal Information: How Believing That One Is Strong Can Sometimes Be a Defensive Weakness". Personality and Social Psychology Bulletin 30 (12): 1565–1584. doi:10.1177/0146167204271180.

- Fischer, P.; Fischer, Julia K.; Aydin, Nilüfer; Frey, Dieter (2010). "Physically Attractive Social Information Sources Lead to Increased Selective Exposure to Information". Basic and Applied Social Psychology 32 (4): 340–347. doi:10.1080/01973533.2010.519208.

- Stanovich, K. E.; West, R. F.; Toplak, M. E. (2013). "Myside Bias, Rational Thinking, and Intelligence". Current Directions in Psychological Science 22 (4): 259–264. doi:10.1177/0963721413480174.

- Mynatt, Clifford R.; Doherty, Michael E.; Tweney, Ryan D. (1978), "Consequences of confirmation and disconfirmation in a simulated research environment", Quarterly Journal of Experimental Psychology 30 (3): 395–406, doi:10.1080/00335557843000007

- Kida 2006، صفحة 157

- Lord, Charles G.; Ross, Lee; Lepper, Mark R. (1979), "Biased assimilation and attitude polarization: The effects of prior theories on subsequently considered evidence", Journal of Personality and Social Psychology (American Psychological Association) 37 (11): 2098–2109, doi:10.1037/0022-3514.37.11.2098, ISSN 0022-3514

- Baron 2000, pp. 201–202

- Vyse 1997, p. 122

- Taber, Charles S.; Lodge, Milton (July 2006), "Motivated Skepticism in the Evaluation of Political Beliefs", American Journal of Political Science (Midwest Political Science Association) 50 (3): 755–769, doi:10.1111/j.1540-5907.2006.00214.x, ISSN 0092-5853

- Westen, Drew; Blagov, Pavel S.; Harenski, Keith; Kilts, Clint; Hamann, Stephan (2006), "Neural Bases of Motivated Reasoning: An fMRI Study of Emotional Constraints on Partisan Political Judgment in the 2004 U.S. Presidential Election", Journal of Cognitive Neuroscience (Massachusetts Institute of Technology) 18 (11): 1947–1958, doi:10.1162/jocn.2006.18.11.1947, ببمد 17069484, retrieved 2009-08-14

- Gadenne, V.; Oswald, M. (1986), "Entstehung und Veränderung von Bestätigungstendenzen beim Testen von Hypothesen [Formation and alteration of confirmatory tendencies during the testing of hypotheses]", Zeitschrift für experimentelle und angewandte Psychologie 33: 360–374 via Oswald & Grosjean 2004, p. 89

- Hastie, Reid; Park, Bernadette (2005), "The Relationship Between Memory and Judgment Depends on Whether the Judgment Task is Memory-Based or On-Line", in Hamilton, David L., Social cognition: key readings, New York: Psychology Press, p. 394, ISBN 0-86377-591-8, OCLC 55078722

- Oswald & Grosjean 2004، صفحات 88–89

- Stangor, Charles; McMillan, David (1992), "Memory for expectancy-congruent and expectancy-incongruent information: A review of the social and social developmental literatures", Psychological Bulletin (American Psychological Association) 111 (1): 42–61, doi:10.1037/0033-2909.111.1.42

- Snyder, M.; Cantor, N. (1979), "Testing hypotheses about other people: the use of historical knowledge", Journal of Experimental Social Psychology 15 (4): 330–342, doi:10.1016/0022-1031(79)90042-8 via Goldacre 2008, p. 231

- Kunda 1999، صفحات 225–232

- Sanitioso, Rasyid; Kunda, Ziva; Fong, G.T. (1990), "Motivated recruitment of autobiographical memories", Journal of Personality and Social Psychology (American Psychological Association) 59 (2): 229–241, doi:10.1037/0022-3514.59.2.229, ISSN 0022-3514, ببمد 2213492

- Levine, L.; Prohaska, V.; Burgess, S.L.; Rice, J.A.; Laulhere, T.M. (2001). "Remembering past emotions: The role of current appraisals.". Cognition and Emotion 15: 393–417. doi:10.1080/02699930125955.

- Safer, M.A.; Bonanno, G.A.; Field, N. (2001). ""It was never that bad": Biased recall of grief and long-term adjustment to the death of a spouse". Memory 9 (3): 195–203. doi:10.1080/09658210143000065.

- Russell, Dan; Jones, Warren H. (1980), "When superstition fails: Reactions to disconfirmation of paranormal beliefs", Personality and Social Psychology Bulletin (Society for Personality and Social Psychology) 6 (1): 83–88, doi:10.1177/014616728061012, ISSN 1552-7433 via Vyse 1997, p. 121

- Kuhn, Deanna; Lao, Joseph (March 1996), "Effects of Evidence on Attitudes: Is Polarization the Norm?", Psychological Science (American Psychological Society) 7 (2): 115–120, doi:10.1111/j.1467-9280.1996.tb00340.x

- Baron 2000, p. 201

- Miller, A.G.; McHoskey, J.W.; Bane, C.M.; Dowd, T.G. (1993), "The attitude polarization phenomenon: Role of response measure, attitude extremity, and behavioral consequences of reported attitude change", Journal of Personality and Social Psychology 64 (4): 561–574, doi:10.1037/0022-3514.64.4.561

- "backfire effect". The Skeptic's Dictionary. Retrieved 26 April 2012.

- Silverman, Craig (2011-06-17). "The Backfire Effect". Columbia Journalism Review. Retrieved 2012-05-01. "When your deepest convictions are challenged by contradictory evidence, your beliefs get stronger."

- Nyhan, Brendan; Reifler, Jason (2010). "When Corrections Fail: The Persistence of Political Misperceptions". Political Behavior 32 (2): 303–330. doi:10.1007/s11109-010-9112-2. Retrieved 1 May 2012.

- Ross, Lee; Anderson, Craig A. (1982), "Shortcomings in the attribution process: On the origins and maintenance of erroneous social assessments", in Kahneman, Daniel; Slovic, Paul; Tversky, Amos, Judgment under uncertainty: Heuristics and biases, Cambridge University Press, pp. 129–152, (ردمك 978-0-521-28414-1), OCLC 7578020

- Nickerson 1998, p. 187

- Kunda 1999, p. 99

- Ross, Lee; Lepper, Mark R.; Hubbard, Michael (1975), "Perseverance in self-perception and social perception: Biased attributional processes in the debriefing paradigm", Journal of Personality and Social Psychology (American Psychological Association) 32 (5): 880–892, doi:10.1037/0022-3514.32.5.880, ISSN 0022-3514, ببمد 1185517 via Kunda 1999, p. 99

- Anderson, Craig A.; Lepper, Mark R.; Ross, Lee (1980), "Perseverance of Social Theories: The Role of Explanation in the Persistence of Discredited Information", Journal of Personality and Social Psychology (American Psychological Association) 39 (6): 1037–1049, doi:10.1037/h0077720, ISSN 0022-3514

- Baron 2000, pp. 197–200

- Fine 2006، صفحات 66–70

- Plous 1993، صفحات 164–166

- Redelmeir, D. A.; Tversky, Amos (1996), "On the belief that arthritis pain is related to the weather", Proceedings of the National Academy of Sciences, 93, صفحات 2895–2896, doi:10.1073/pnas.93.7.2895 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) via Kunda 1999، صفحة 127 - Kunda 1999، صفحات 127–130

- Plous 1993، صفحات 162–164

- Stanovich, K. E.; West, R. F.; Toplak, M. E. (5 أغسطس 2013). "Myside Bias, Rational Thinking, and Intelligence". Current Directions in Psychological Science. 22 (4): 259–264. doi:10.1177/0963721413480174. الوسيط

|CitationClass=تم تجاهله (مساعدة) - Baron, Jonathan (1995). "Myside bias in thinking about abortion". Thinking & Reasoning: 221–235. الوسيط

|CitationClass=تم تجاهله (مساعدة) - Wolfe, Christopher; Anne Britt (2008). "The locus of the myside bias in written argumentation" (PDF). Thinking & Reasoning. 14: 1–27. doi:10.1080/13546780701527674. مؤرشف من الأصل (PDF) في 4 مارس 2016. الوسيط

|CitationClass=تم تجاهله (مساعدة) - Mason, Lucia; Scirica, Fabio (أكتوبر 2006). "Prediction of students' argumentation skills about controversial topics by epistemological understanding". Learning and Instruction. 16 (5): 492–509. doi:10.1016/j.learninstruc.2006.09.007. الوسيط

|CitationClass=تم تجاهله (مساعدة) - Weinstock, Michael (ديسمبر 2009). "Relative expertise in an everyday reasoning task: Epistemic understanding, problem representation, and reasoning competence". Learning and Individual Differences. 19 (4): 423–434. doi:10.1016/j.lindif.2009.03.003. الوسيط

|CitationClass=تم تجاهله (مساعدة) - Weinstock, Michael; Neuman, Yair; Tabak, Iris (يناير 2004). "Missing the point or missing the norms? Epistemological norms as predictors of students' ability to identify fallacious arguments". Contemporary Educational Psychology. 29 (1): 77–94. doi:10.1016/S0361-476X(03)00024-9. الوسيط

|CitationClass=تم تجاهله (مساعدة) - ثيوسيديديس Thucydides Thuc. 4.108.4 نسخة محفوظة 04 فبراير 2017 على موقع واي باك مشين.

- Alighieri, Dante. Paradiso canto XIII: 118–120. Trans. Allen Mandelbaum

- Baron 2000، صفحات 195–196

- Bacon, Francis (1620). Novum Organum. reprinted in Burtt, E.A., المحرر (1939), The English philosophers from Bacon to Mill, New York: Random House, صفحة 36 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) via Nickerson 1998، صفحة 176 - Tolstoy, Leo. What is Art? p. 124 (1899). In The Kingdom of God Is Within You (1893), he similarly declared, "The most difficult participants can be explained to the most slow-witted man if he has not formed any idea of them already; but the simplest thing cannot be made clear to the most intelligent man if he is firmly persuaded that he knows already, without a shadow of doubt, what is laid before him" (ch. 3). Translated from the Russian by Constance Garnett, New York, 1894. Project Gutenberg edition released November 2002. Retrieved 2009-08-24. "what+is+art"&output=html&source=gbs_search_r&cad=1 نسخة محفوظة 01 مارس 2017 على موقع واي باك مشين.

- Gale, Maggie; Ball, Linden J. (2002), "Does Positivity Bias Explain Patterns of Performance on Wason's 2-4-6 task?", in Gray, Wayne D.; Schunn, Christian D. (المحررون), Proceedings of the Twenty-Fourth Annual Conference of the Cognitive Science Society, Routledge, صفحة 340, ISBN 978-0-8058-4581-5, OCLC 469971634 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Wason, Peter C. (1960), "On the failure to eliminate hypotheses in a conceptual task", Quarterly Journal of Experimental Psychology, Psychology Press, 12, صفحات 129–140, doi:10.1080/17470216008416717, ISSN 1747-0226 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Nickerson 1998، صفحة 179

- Lewicka 1998، صفحة 238

- Oswald & Grosjean 2004، صفحات 79–96

- Wason, Peter C. (1968), "Reasoning about a rule", Quarterly Journal of Experimental Psychology, Psychology Press, 20, صفحات 273–28, doi:10.1080/14640746808400161, ISSN 1747-0226 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Sutherland, Stuart (2007), Irrationality (الطبعة 2nd), London: Pinter and Martin, صفحات 95–103, ISBN 978-1-905177-07-3, OCLC 72151566 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Barkow, Jerome H.; Cosmides, Leda; Tooby, John (1995), The adapted mind: evolutionary psychology and the generation of culture, Oxford University Press US, صفحات 181–184, ISBN 978-0-19-510107-2, OCLC 33832963 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Oswald & Grosjean 2004، صفحات 81–82, 86–87

- Plous 1993, p. 233

- Lewicka 1998، صفحة 239

- Tweney, Ryan D.; Doherty, Michael E.; Worner, Winifred J.; Pliske, Daniel B.; Mynatt, Clifford R.; Gross, Kimberly A.; Arkkelin, Daniel L. (1980), "Strategies of rule discovery in an inference task", The Quarterly Journal of Experimental Psychology, Psychology Press, 32, صفحات 109–123, doi:10.1080/00335558008248237, ISSN 1747-0226 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) (Experiment IV) - Oswald & Grosjean 2004، صفحات 86–89

- Hergovich, Schott & Burger 2010

- Maccoun 1998

- Friedrich 1993، صفحة 298

- Kunda 1999، صفحة 94

- Nickerson 1998، صفحات 198–199

- Nickerson 1998، صفحة 200

- Nickerson 1998، صفحة 197

- Baron 2000، صفحة 206

- Matlin, Margaret W. (2004), "Pollyanna Principle", in Pohl, Rüdiger F. (المحرر), Cognitive Illusions: A Handbook on Fallacies and Biases in Thinking, Judgement and Memory, Hove: Psychology Press, صفحات 255–272, ISBN 978-1-84169-351-4, OCLC 55124398, مؤرشف من الأصل في 26 يناير 2020 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Dawson, Erica; Gilovich, Thomas; Regan, Dennis T. (أكتوبر 2002), "Motivated Reasoning and Performance on the Wason Selection Task" (PDF), Personality and Social Psychology Bulletin, Society for Personality and Social Psychology, 28, صفحات 1379–1387, doi:10.1177/014616702236869, مؤرشف من الأصل (PDF) في 12 يوليو 2012, اطلع عليه بتاريخ 30 سبتمبر 2009 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Ditto, Peter H.; Lopez, David F. (1992), "Motivated skepticism: use of differential decision criteria for preferred and nonpreferred conclusions", Journal of personality and social psychology, American Psychological Association, 63, صفحات 568–584, doi:10.1037/0022-3514.63.4.568, ISSN 0022-3514 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Nickerson 1998، صفحة 198

- Oswald & Grosjean 2004، صفحات 91–93

- Friedrich 1993، صفحات 299, 316–317

- Trope, Y.; Liberman, A. (1996), "Social hypothesis testing: cognitive and motivational mechanisms", in Higgins, E. Tory; Kruglanski, Arie W. (المحررون), Social Psychology: Handbook of basic principles, New York: Guilford Press, ISBN 978-1-57230-100-9, OCLC 34731629 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) via Oswald & Grosjean 2004، صفحات 91–93 - Dardenne, Benoit; Leyens, Jacques-Philippe (1995), "Confirmation Bias as a Social Skill", Personality and Social Psychology Bulletin, Society for Personality and Social Psychology, 21, صفحات 1229–1239, doi:10.1177/01461672952111011, ISSN 1552-7433 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Shanteau, James (2003). Sandra L. Schneider (المحرر). Emerging perspectives on judgment and decision research. Cambridge [u.a.]: Cambridge University Press. صفحة 445. ISBN 0-521-52718-X. مؤرشف من الأصل في 26 يناير 2020. الوسيط

|CitationClass=تم تجاهله (مساعدة) - Haidt, Jonathan (2012). The Righteous Mind : Why Good People are Divided by Politics and Religion. New York: Pantheon Books. صفحات 1473–4 (e-book edition). ISBN 0-307-37790-3. الوسيط

|CitationClass=تم تجاهله (مساعدة) - Lindzey, edited by Susan T. Fiske, Daniel T. Gilbert, Gardner (2010). The handbook of social psychology (الطبعة 5th). Hoboken, N.J.: Wiley. صفحة 811. ISBN 0-470-13749-5. مؤرشف من الأصل في 26 يناير 2020. الوسيط

|CitationClass=تم تجاهله (مساعدة)صيانة CS1: نص إضافي: قائمة المؤلفون (link) - Pompian, Michael M. (2006), Behavioral finance and wealth management: how to build optimal portfolios that account for investor biases, John Wiley and Sons, صفحات 187–190, ISBN 978-0-471-74517-4, OCLC 61864118 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Hilton, Denis J. (2001), "The psychology of financial decision-making: Applications to trading, dealing, and investment analysis", Journal of Behavioral Finance, Institute of Behavioral Finance, 2, صفحات 37–39, doi:10.1207/S15327760JPFM0201_4, ISSN 1542-7579 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Krueger, David; Mann, John David (2009), The Secret Language of Money: How to Make Smarter Financial Decisions and Live a Richer Life, McGraw Hill Professional, صفحات 112–113, ISBN 978-0-07-162339-1, OCLC 277205993 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Nickerson 1998، صفحة 192

- Goldacre 2008، صفحة 233

- Singh, Simon; Ernst, Edzard (2008), Trick or Treatment?: Alternative Medicine on Trial, London: Bantam, صفحات 287–288, ISBN 978-0-593-06129-9 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Atwood, Kimball (2004), "Naturopathy, Pseudoscience, and Medicine: Myths and Fallacies vs Truth", Medscape General Medicine, 6, صفحة 33 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Neenan, Michael; Dryden, Windy (2004), Cognitive therapy: 100 key points and techniques, Psychology Press, صفحة ix, ISBN 978-1-58391-858-6, OCLC 474568621 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Blackburn, Ivy-Marie; Davidson, Kate M. (1995), Cognitive therapy for depression & anxiety: a practitioner's guide (الطبعة 2), Wiley-Blackwell, صفحة 19, ISBN 978-0-632-03986-9, OCLC 32699443 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Harvey, Allison G.; Watkins, Edward; Mansell, Warren (2004), Cognitive behavioural processes across psychological disorders: a transdiagnostic approach to research and treatment, Oxford University Press, صفحات 172–173, 176, ISBN 978-0-19-852888-3, OCLC 602015097 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Nickerson 1998، صفحات 191–193

- Myers, D.G.; Lamm, H. (1976), "The group polarization phenomenon", Psychological Bulletin, 83, صفحات 602–627, doi:10.1037/0033-2909.83.4.602 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) via Nickerson 1998، صفحات 193–194 - Halpern, Diane F. (1987), Critical thinking across the curriculum: a brief edition of thought and knowledge, Lawrence Erlbaum Associates, صفحة 194, ISBN 978-0-8058-2731-6, OCLC 37180929 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Roach, Kent (2010), "Wrongful Convictions: Adversarial and Inquisitorial Themes", North Carolina Journal of International Law and Commercial Regulation, 35, SSRN = 1619124 1619124,

Both adversarial and inquisitorial systems seem subject to the dangers of tunnel vision or confirmation bias.

الوسيط|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Baron 2000، صفحات 191,195

- Kida 2006، صفحة 155

- Tetlock, Philip E. (2005), Expert Political Judgment: How Good Is It? How Can We Know?, Princeton, N.J.: Princeton University Press, صفحات 125–128, ISBN 978-0-691-12302-8, OCLC 56825108 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - "David Camm Blog: Investigation under fire". WDRB. 10 أكتوبر 2013. مؤرشف من الأصل في 21 يونيو 2017. الوسيط

|CitationClass=تم تجاهله (مساعدة) - Kircher, Travis. "David Camm blogsite: opening statements". WDRB. مؤرشف من الأصل في 11 سبتمبر 2018. اطلع عليه بتاريخ 3 يناير 2014. الوسيط

|CitationClass=تم تجاهله (مساعدة) - "David Camm v. State of Indiana" (PDF). Court of Appeals of Indiana. 2011-11-15. مؤرشف من الأصل (PDF) في 2 مارس 2017. الوسيط

|CitationClass=تم تجاهله (مساعدة) - Boyd, Gordon (10 سبتمبر 2013). "Camm trial 9/10: Defense finds inconsistencies but can't touch Boney's past". WBRC. مؤرشف من الأصل في 14 يونيو 2015. الوسيط

|CitationClass=تم تجاهله (مساعدة) - Zambroski,James. "Witness Says Prosecutor In First Camm Trial Blew Up When She Couldn't Link Camm's DNA To Boney's Shirt". WAVE News. مؤرشف من الأصل في 01 أبريل 2017. الوسيط

|CitationClass=تم تجاهله (مساعدة); تحقق من التاريخ في:|تاريخ أرشيف=(مساعدة) - Eisenmenger, Sarah (9 سبتمبر 2013). "Convicted Killer Charles Boney says David Camm was the shooter". wave3. مؤرشف من الأصل في 29 سبتمبر 2017. اطلع عليه بتاريخ 5 يناير 2014. الوسيط

|CitationClass=تم تجاهله (مساعدة) - Eisenmenger, Sarah (سبتمبر 9, 2013). "Convicted Killer Charles Boney says David Camm was the shooter". wave3. مؤرشف من الأصل في 29 سبتمبر 2017. الوسيط

|CitationClass=تم تجاهله (مساعدة) - Adams, Harold J. (2011-02-18). "David Camm's attorney's appeal ruling, seek prosecutor's removal". Courier Journal, page B1. الوسيط

|CitationClass=تم تجاهله (مساعدة) - David Camm verdict: NOT GUILTY, WDRB TV, October 24, 2013 نسخة محفوظة 07 أبريل 2017 على موقع واي باك مشين.

- Smith, Jonathan C. (2009), Pseudoscience and Extraordinary Claims of the Paranormal: A Critical Thinker's Toolkit, John Wiley and Sons, صفحات 149–151, ISBN 978-1-4051-8122-8, OCLC 319499491 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Randi, James (1991), James Randi: psychic investigator, Boxtree, صفحات 58–62, ISBN 978-1-85283-144-8, OCLC 26359284 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Nickerson 1998، صفحة 190

- Nickerson 1998، صفحات 192–194

- Koehler 1993

- Mahoney 1977

- Proctor, Robert W.; Capaldi, E. John (2006), Why science matters: understanding the methods of psychological research, Wiley-Blackwell, صفحة 68, ISBN 978-1-4051-3049-3, OCLC 318365881 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Sternberg, Robert J. (2007), "Critical Thinking in Psychology: It really is critical", in Sternberg, Robert J.; Roediger III, Henry L.; Halpern, Diane F. (المحررون), Critical Thinking in Psychology, Cambridge University Press, صفحة 292, ISBN 0-521-60834-1, OCLC 69423179,

Some of the worst examples of confirmation bias are in research on parapsychology ... Arguably, there is a whole field here with no powerful confirming data at all. But people want to believe, and so they find ways to believe.

الوسيط|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Shadish, William R. (2007), "Critical Thinking in Quasi-Experimentation", in Sternberg, Robert J.; Roediger III, Henry L.; Halpern, Diane F., Critical Thinking in Psychology, Cambridge University Press, p. 49, (ردمك 978-0-521-60834-3)

- Jüni, P.; Altman, D. G.; Egger, M. (2001). "Systematic reviews in health care: Assessing the quality of controlled clinical trials". BMJ (Clinical research ed.) 323 (7303): 42–46. doi:10.1136/bmj.323.7303.42. PMC 1120670. ببمد 11440947.

- Shermer, Michael (July 2006), "The Political Brain", Scientific American, ISSN 0036-8733, retrieved 2009-08-14

- Emerson, G. B.; Warme, W. J.; Wolf, F. M.; Heckman, J. D.; Brand, R. A.; Leopold, S. S. (2010). "Testing for the Presence of Positive-Outcome Bias in Peer Review: A Randomized Controlled Trial". Archives of Internal Medicine 170 (21): 1934–1939. doi:10.1001/archinternmed.2010.406. ببمد 21098355.

- Horrobin 1990

- Swann, William B.; Pelham, Brett W.; Krull, Douglas S. (1989), "Agreeable Fancy or Disagreeable Truth? Reconciling Self-Enhancement and Self-Verification", Journal of Personality and Social Psychology, American Psychological Association, 57, صفحات 782–791, doi:10.1037/0022-3514.57.5.782, ISSN 0022-3514, PMID 2810025 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Swann, William B.; Read, Stephen J. (1981), "Self-Verification Processes: How We Sustain Our Self-Conceptions", Journal of Experimental Social Psychology, Academic Press, 17, صفحات 351–372, doi:10.1016/0022-1031(81)90043-3, ISSN 0022-1031 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Story, Amber L. (1998), "Self-Esteem and Memory for Favorable and Unfavorable Personality Feedback", Personality and Social Psychology Bulletin, Society for Personality and Social Psychology, 24, صفحات 51–64, doi:10.1177/0146167298241004, ISSN 1552-7433 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - White, Michael J.; Brockett, Daniel R.; Overstreet, Belinda G. (1993), "Confirmatory Bias in Evaluating Personality Test Information: Am I Really That Kind of Person?", Journal of Counseling Psychology, American Psychological Association, 40, صفحات 120–126, doi:10.1037/0022-0167.40.1.120, ISSN 0022-0167 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Swann, William B.; Read, Stephen J. (1981), "Acquiring Self-Knowledge: The Search for Feedback That Fits", Journal of Personality and Social Psychology, American Psychological Association, 41, صفحات 1119–1128, doi:10.1037/0022-3514.41.6.1119, ISSN 0022-3514 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Shrauger, J. Sidney; Lund, Adrian K. (1975), "Self-evaluation and reactions to evaluations from others", Journal of Personality, Duke University Press, 43, صفحات 94–108, doi:10.1111/j.1467-6494.1975.tb00574, PMID 1142062 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link)

مصادر

- Baron, Jonathan (2000), Thinking and deciding (الطبعة 3rd), New York: Cambridge University Press, ISBN 0-521-65030-5, OCLC 316403966 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Fine, Cordelia (2006), A Mind of its Own: how your brain distorts and deceives, Cambridge, UK: Icon books, ISBN 1-84046-678-2, OCLC 60668289 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Friedrich, James (1993), "Primary error detection and minimization (PEDMIN) strategies in social cognition: a reinterpretation of confirmation bias phenomena", Psychological Review, American Psychological Association, 100, صفحات 298–319, doi:10.1037/0033-295X.100.2.298, ISSN 0033-295X, PMID 8483985 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Goldacre, Ben (2008), Bad Science, London: Fourth Estate, ISBN 978-0-00-724019-7, OCLC 259713114 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Hergovich, Andreas; Schott, Reinhard; Burger, Christoph (2010), "Biased Evaluation of Abstracts Depending on Topic and Conclusion: Further Evidence of a Confirmation Bias Within Scientific Psychology", Current Psychology, 29, صفحات 188–209, doi:10.1007/s12144-010-9087-5 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Horrobin, David F. (1990), "The philosophical basis of peer review and the suppression of innovation", Journal of the American Medical Association, 263, صفحات 1438–1441, doi:10.1001/jama.263.10.1438, PMID 2304222 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Kida, Thomas E. (2006), Don't believe everything you think: the 6 basic mistakes we make in thinking, Amherst, New York: Prometheus Books, ISBN 978-1-59102-408-8, OCLC 63297791 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Koehler, Jonathan J. (1993), "The influence of prior beliefs on scientific judgments of evidence quality", Organizational Behavior and Human Decision Processes, 56, صفحات 28–55, doi:10.1006/obhd.1993.1044 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Kunda, Ziva (1999), Social Cognition: Making Sense of People, MIT Press, ISBN 978-0-262-61143-5, OCLC 40618974 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Lewicka, Maria (1998), "Confirmation Bias: Cognitive Error or Adaptive Strategy of Action Control?", in Kofta, Mirosław; Weary, Gifford; Sedek, Grzegorz (المحررون), Personal control in action: cognitive and motivational mechanisms, Springer, صفحات 233–255, ISBN 978-0-306-45720-3, OCLC 39002877 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Maccoun, Robert J. (1998), "Biases in the interpretation and use of research results" (PDF), Annual Review of Psychology, 49, صفحات 259–87, doi:10.1146/annurev.psych.49.1.259, PMID 15012470 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Mahoney, Michael J. (1977), "Publication prejudices: an experimental study of confirmatory bias in the peer review system", Cognitive Therapy and Research, 1, صفحات 161–175, doi:10.1007/BF01173636 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Nickerson, Raymond S. (1998), "Confirmation Bias; A Ubiquitous Phenomenon in Many Guises", Review of General Psychology, Educational Publishing Foundation, 2, صفحات 175–220, doi:10.1037/1089-2680.2.2.175, ISSN 1089-2680 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Oswald, Margit E.; Grosjean, Stefan (2004), "Confirmation Bias", in Pohl, Rüdiger F. (المحرر), Cognitive Illusions: A Handbook on Fallacies and Biases in Thinking, Judgement and Memory, Hove, UK: Psychology Press, صفحات 79–96, ISBN 978-1-84169-351-4, OCLC 55124398 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Plous, Scott (1993), The Psychology of Judgment and Decision Making, McGraw-Hill, ISBN 978-0-07-050477-6, OCLC 26931106 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Poletiek, Fenna (2001), Hypothesis-testing behaviour, Hove, UK: Psychology Press, ISBN 978-1-84169-159-6, OCLC 44683470 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Risen, Jane; Gilovich, Thomas (2007), "Informal Logical Fallacies", in Sternberg, Robert J.; Roediger III, Henry L.; Halpern, Diane F. (المحررون), Critical Thinking in Psychology, Cambridge University Press, صفحات 110–130, ISBN 978-0-521-60834-3, OCLC 69423179 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Vyse, Stuart A. (1997), Believing in magic: The psychology of superstition, New York: Oxford University Press, ISBN 0-19-513634-9, OCLC 35025826 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link)

اقرأ أيضًا

- Stanovich, Keith (2009), What Intelligence Tests Miss: The Psychology of Rational Thought, New Haven (CT): Yale University Press, ISBN 978-0-300-12385-2, ضع ملخصا (PDF) (21 November 2010) الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Westen, Drew (2007), The political brain: the role of emotion in deciding the fate of the nation, PublicAffairs, ISBN 978-1-58648-425-5, OCLC 86117725 الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Keohane, Joe (11 يوليو 2010), "How facts backfire: Researchers discover a surprising threat to democracy: our brains", Boston Globe, NY Times الوسيط

|CitationClass=تم تجاهله (مساعدة); الوسيط|separator=تم تجاهله (مساعدة)CS1 maint: ref=harv (link) - Leavitt, Fred: "Dancing with Absurdity: Your Most Cherished Beliefs (and All Your Others) are Probably Wrong. (2015) Peter Lang Publishers.

وصلات خارجية

- قاموس المُشككين: انحياز تأكيدي كتبه روبرت تود كارول.

- تدريس الانحياز التأكيدي، مذكرة للصف وملاحظات المُعلم كتبها كيه اتش جروبمان

- الانحياز التأكيدي على موقع You Are Not So Smart

- نشاط تفاعلي لتعلم الانحياز التأكيدي، تدريب تفاعلي بأرقام ثلاثية صممه رود ماكفارلاند لجامعة سيمون فريز

- ملخص مختصر لدراسة الانحياز الاستيعابي في ستانفورد عام 1979 بواسطة كيث رولاج، جامعة بابسون

- بوابة علوم

- بوابة فلسفة

- بوابة فلسفة العلوم

- بوابة السياسة

- بوابة إحصاء

- بوابة علم النفس

- بوابة تفكير

- بوابة منطق